NVIDIA Mellanox ConnectX-6 MCX653106A-HDAT อะแดปเตอร์อัจฉริยะ InfiniBand แบบสองพอร์ต 200Gb/s – PCIe 4.0 x16, In-Network Computing

รายละเอียดสินค้า:

| ชื่อแบรนด์: | Mellanox |

| หมายเลขรุ่น: | MCX653106A-HDAT-SP |

| เอกสาร: | connectx-6-infiniband.pdf |

การชำระเงิน:

| จำนวนสั่งซื้อขั้นต่ำ: | 1 ชิ้น |

|---|---|

| ราคา: | Negotiate |

| รายละเอียดการบรรจุ: | กล่องด้านนอก |

| เวลาการส่งมอบ: | ขึ้นอยู่กับสินค้าคงคลัง |

| เงื่อนไขการชำระเงิน: | ที/ที |

| สามารถในการผลิต: | จัดหาโดย Project/Batch |

|

ข้อมูลรายละเอียด |

|||

| สถานะผลิตภัณฑ์: | คลังสินค้า | แอปพลิเคชัน: | เซิร์ฟเวอร์ |

|---|---|---|---|

| เงื่อนไข: | ใหม่และเป็นต้นฉบับ | พิมพ์: | แบบมีสาย |

| ความเร็วสูงสุด: | สูงถึง 200 gb/s | ตัวเชื่อมต่ออีเธอร์เน็ต: | QSFP56 |

| แบบอย่าง: | MCX653106A-HDAT | ชื่อ: | MCX653106A-HDAT-SP การ์ดเครือข่าย Mellanox 200gbe สมาร์ทเซฟความเร็วสูง |

| เน้น: | อะแดปเตอร์เครือข่าย Mellanox ConnectX-6,อะแดปเตอร์อัจฉริยะ InfiniBand 200Gb/s,การ์ดเครือข่าย PCIe 4.0 X16 |

||

รายละเอียดสินค้า

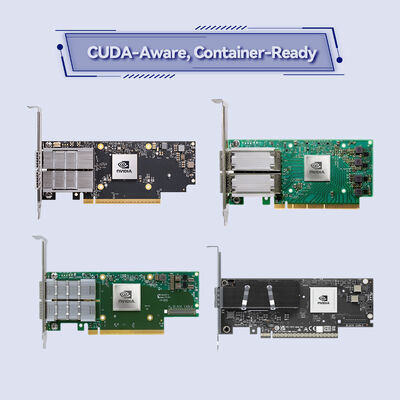

NVIDIA ConnectX-6 MCX653106A-HDAT 200Gb/s อัดแปลงสมาร์ท InfiniBand แบบสองท่า

การ์ดปรับปรุงสมาร์ท InfiniBand และ Ethernet 200Gb / s ที่นํารั้งในอุตสาหกรรมที่มีพอร์ต QSFP56 สองตัว ให้นําการเร่งคอมพิวเตอร์ในเครือข่าย, การเข้ารหัสระดับบล็อก และ PCIe 4อินเตอร์เฟซโฮสต์ 0 x16 สําหรับ HPC, AI และศูนย์ข้อมูลในเมฆ

- การเชื่อมต่อ InfiniBand (HDR) 200Gb/s หรือ 200/100/50/40/25/10GbE

- PCIe Gen 4.0 x16 (ยังเข้ากันได้กับ Gen 3.0)

- การลดภาระของฮาร์ดแวร์: NVMe-oF เป้าหมาย/ผู้เริ่มต้น, การเข้ารหัส XTS-AES 256/512 บิต, MPI tag matching

- การสนับสนุน NVIDIA In-Network Computing และ GPUDirect RDMA

- ปัจจัยรูปแบบ PCIe แบบยืนระดับต่ํา, RoHS compliant

ลักษณะ

- ความเร็ว 200Gb/s:การทํางานที่พอร์ตสองสายสูงสุด 200Gb/s ใน InfiniBand (HDR) หรือ Ethernet ด้วยความกว้างแดนสองทิศเต็ม

- การคิดเลขในเครือข่าย:ทําการทํางานรวม (MPI, NCCL, SHMEM) โดยใช้เทคโนโลยี NVIDIA SHARP

- การเข้ารหัสระดับบล็อก:แฮร์ดแวร์ AES-XTS 256/512 บิต การเข้ารหัส/ออกรหัส โดยไม่ต้องใช้ค่า CPU; สอดคล้องกับ FIPS

- NVMe-oF การปลดน้ํา:เป้าหมายและการเริ่มต้นการลดภาระสําหรับ NVMe ผ่าน Fabrics ลดการใช้ CPU

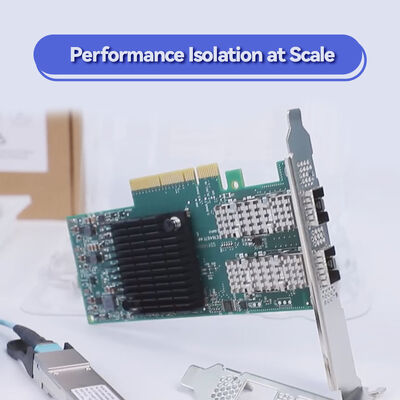

- การเวอร์ชูเอเลชั่นระดับสูง:SR-IOV ถึง 1K VFs, การเร่ง ASAP2 สําหรับ OVS และการสวิตชิ่งแบบแท้

เทคโนโลยีและมาตรฐาน

MCX653106A-HDAT รวมNVIDIA In-Network Computing การคิดเลขในเครือข่ายเครื่องยนต์ (SHARP)RDMA (IBTA 1.3),RoCEและNVMe-oFมันรองรับPCIe Gen 4.0 (32 เลนเป็น 2x16),PAM4 และ NRZ SerDes, และคุณสมบัติที่ระดับสูง เช่นการขนส่งที่เชื่อมโยงแบบไดนามิก (DCT),การเรียกใช้งานตามความต้องการ (ODP)และการปรับเปลี่ยนเส้นทาง. Overlay offloads สําหรับ VXLAN, NVGRE, Geneve ได้มีการเร่งคอมพิวเตอร์ สอดคล้องกับ IEEE 802.3bj, 802.3bm, 802.3by และ InfiniBand Trade Association.

หลักการการทํางาน: อาร์คิเทคชันออฟโหลดสมาร์ท

ConnectX-6 เปลี่ยนงานการสื่อสารและการเก็บข้อมูลจาก CPU ที่เป็นเจ้าภาพไปยังฮาร์ดแวร์ของตัวปรับ (adapter) สําหรับ MPI คอลเลคทีฟ ตัวปรับจะประมวลผลข้อมูลในการขนส่งโดยใช้ SHARP โดยลดการจราจรของจุดปลายสําหรับการเก็บ, NVMe-oF คําสั่งถูกประมวลผลโดยตรงบนตัวปรับ, ปลดปล่อย CPU คอร์. การรหัส / การรหัสบล็อกเกิดขึ้นในสายที่ความเร็วสาย. ผลคือความช้าต่ํา, อัตราการส่งข้อความที่สูงกว่า (215 Mpps) และการปรับขนาดการใช้งานที่ดีขึ้น.

การใช้งานและการใช้งาน

- คลัสเตอร์ HPC:การจําลองที่ใช้ MPI ต้องการความช้าต่ําและอัตราการส่งข้อความสูง

- การฝึก AI:NVIDIA GPU คลัสเตอร์กับ GPUDirect RDMA และ NCCL คอลเลคทีฟ

- การเก็บของ NVMe-oF:เป้าหมาย / เริ่มต้นการอํานวยความสะดวกสําหรับการเข้าถึงการเก็บข้อมูล NVMe ที่มีความสามารถสูง

- ศูนย์ข้อมูลเสมือน:SR-IOV และ ASAP2 สําหรับ OVS ลงโหลดใน NFV และเมฆ

- เซอร์เวอร์หลายโซเก็ต:การตั้งค่า Socket Direct เพื่อเลี่ยง QPI/UPI

เฉพาะเจาะจงทางเทคนิค และตัวเลือกการสั่งซื้อ

| รุ่น | สนามบินและความเร็ว | อินเตอร์เฟซโฮสต์ | ปัจจัยรูปแบบ | การเข้ารหัส | โปรต็อกอล | OPN |

|---|---|---|---|---|---|---|

| ConnectX-6 | 2x QSFP56 (200Gb/s IB/Eth) | PCIe 4.0 x16 (ที่เข้ากันได้กับ Gen 3) | PCIe stand-up (ระดับต่ํา) | AES-XTS 256/512 บิต | InfiniBand, Ethernet, NVMe-oF | MCX653106A-HDAT |

| ConnectX-6 | 1x QSFP56 (200Gb/s) | PCIe 4.0 x16 | การยืนของ PCIe | AES-XTS | IB/Eth | MCX653105A-HDAT |

| ConnectX-6 | 2x QSFP56 (200Gb/s) | PCIe 4.0 x16 | OCP 30 | AES-XTS | IB/Eth | MCX653436A-HDAT |

หมายเหตุ: MCX653106A-HAT รองรับ 200Gb / s InfiniBand (HDR) และ 200/100/50/25/10GbE. ขนาด: 167.65mm x 68.90mm (โดยไม่ใช้บราคเกต) รวมถึงบราคเกตสูง (อุปกรณ์เสริมบราคเกตสั้น)การบริโภคพลังงาน < 15W.

ข้อดีและความแตกต่าง

- vs. รุ่นก่อน (ConnectX-5):ขนาดความกว้างของแบนด์บิดเพิ่มเป็นสองเท่า (200Gb/s เทียบกับ 100Gb/s) SHARP ที่บูรณาการสําหรับคอมพิวเตอร์ในเครือข่าย และการเข้ารหัสระดับบล็อก

- VS NICs ของผู้แข่งขันหน่วยงานการจัดหาของ NVMe-oF และ MPI จริงๆ ไม่ใช่แค่หน่วยงานการจัดหาที่ไม่มีรัฐ

- ตัวเลือก Socket Direct:มีให้บริการสําหรับเซอร์เวอร์หลายโซเก็ต เพื่อกําจัด UPI / QPI ความคับคี่

- ความสอดคล้องกับ FIPSการเข้ารหัสของฮาร์ดแวร์ตรงกับมาตรฐานความปลอดภัยของรัฐบาล

บริการและการสนับสนุน

เราให้บริการที่ปรึกษาทางเทคนิค 24/7 บริการ RMA และการสนับสนุนการบูรณาการสําหรับ ConnectX-6 adapters ทุกบัตรได้รับการสนับสนุนโดยการรับประกัน 1 ปี (สามารถขยายได้)ทีมงานของเราให้การรับรอง Driver สําหรับการจําหน่าย Linux หลักๆ, Windows, และ VMware มีการสนับสนุนการตั้งค่าก่อนการขายสําหรับการออกแบบผ้า InfiniBand

คําถามที่พบบ่อย (FAQ)

ถาม: MCX653106A-HDAT สามารถใช้สวิทช์ควอนตัม 200Gb/s ได้หรือไม่?

A:ใช่, มันสามารถทํางานร่วมกันได้อย่างสมบูรณ์แบบกับสวิทช์ NVIDIA Quantum QM8700/QM8790 และสวิทช์ Quantum-2 เมื่อใช้โหมด HDR หรือ NDR ด้วยสายไฟที่เหมาะสม

คําถาม: ตัวปรับตัวนี้สามารถใช้ได้สําหรับ Ethernet และ InfiniBand?

A:ใช่ มันรองรับโปรโตคอล InfiniBand และ Ethernet ทั้งคู่ แฟร์มแวร์จะตรวจจับชนิดสวิตช์โดยอัตโนมัติ และตั้งค่าโหมดที่เหมาะสม

ถาม: มันรองรับ RoCE (RDMA over Converged Ethernet) ไหม?

A:ใช่, ConnectX-6 รองรับ RoCE อย่างเต็มที่, ให้ RDMA ความยืดหยุ่นต่ําในสภาพแวดล้อม Ethernet.

Q: อัตราการส่งข้อความสูงสุดเท่าไร?

A:ตัวปรับส่งส่งถึง 215 ล้านข้อความต่อวินาที เหมาะสําหรับภาระงาน HPC แพคเก็ตขนาดเล็ก

คําถาม: การ์ดสามารถใช้สล็อต PCIe Gen 3.0 ได้หรือไม่?

A:ใช่, มันมีความสอดคล้องกลับกับ PCIe Gen 3.0 (x16), แม้ว่าความกว้างแบนด์เบทจะจํากัดถึง ~ 100Gb / s ต่อพอร์ตเนื่องจากข้อจํากัด Gen 3.

ข้อควรระวังและข้อตกลงความสอดคล้อง

- ความต้องการของช่อง PCIe:สําหรับการทํางานเต็ม 200Gb / s, ติดตั้งในสล็อต PCIe Gen 4.0 x16 สล็อต Gen 3.0 จะจํากัดความเร็ว

- การเย็น:รับประกันการไหลของอากาศที่เหมาะสมในเซอร์เวอร์ชัสซี; การเย็นแบบปาสิฟ จําเป็นต้องมีความต่ํา 200 LFM

- การเชื่อมต่อสายไฟ:ใช้ QSFP56 พันธมิตร / พันธมิตร หรือโมดูลออปติกส์ที่มีค่า 200Gb/s (HDR)

- การสนับสนุนคนขับ:ใช้ NVIDIA MLNX_OFED ล่าสุดสําหรับ Linux หรือ WinOF-2 สําหรับ Windows

- อุณหภูมิการทํางาน0 °C ถึง 70 °C; เก็บไว้ระหว่าง -40 °C และ 85 °C

การแนะนําบริษัท

ด้วยประสบการณ์มากกว่าสิบปี เราดําเนินงานโรงงานขนาดใหญ่ ที่ได้รับการสนับสนุนจากทีมงานเทคนิคที่แข็งแรงฐานลูกค้าและความเชี่ยวชาญในกลุ่มที่กว้างใหญ่ของเรา ทําให้เราสามารถนําเสนอราคาที่แข่งขันได้ โดยไม่เสียสละคุณภาพในฐานะผู้จําหน่ายที่ได้รับอนุญาตสําหรับ Mellanox, Ruckus, Aruba และ Extreme เรามีสวิตช์เครือข่ายเดิม, การ์ดเครือข่าย (nic card)เราเก็บสินค้าได้ถึง 10 ล้านดอลลาร์ เพื่อให้การจัดซื้อสินค้าได้อย่างรวดเร็วทุกการส่งสินค้าจะถูกตรวจสอบให้ถูกต้อง และเราให้คําปรึกษาและการสนับสนุนทางเทคนิคตลอด 24 ชั่วโมงทีมงานขายและเทคนิคมืออาชีพของเราได้รับชื่อเสียงสูงในตลาดโลก.