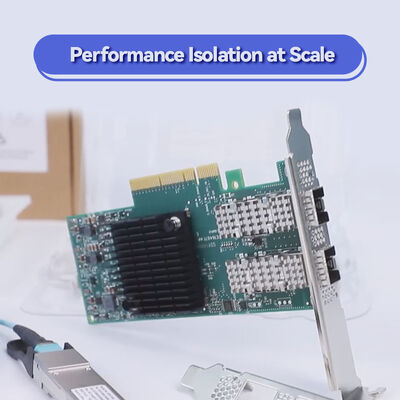

การ์ดเครือข่าย NVIDIA Mellanox ConnectX-6 MCX653106A-ECAT 100Gb/s แบบสองพอร์ต InfiniBand ที่รองรับ Ethernet

รายละเอียดสินค้า:

| ชื่อแบรนด์: | Mellanox |

| หมายเลขรุ่น: | MCX653106A-ECAT |

| เอกสาร: | connectx-6-infiniband.pdf |

การชำระเงิน:

| จำนวนสั่งซื้อขั้นต่ำ: | 1 ชิ้น |

|---|---|

| ราคา: | Negotiate |

| รายละเอียดการบรรจุ: | กล่องด้านนอก |

| เวลาการส่งมอบ: | ขึ้นอยู่กับสินค้าคงคลัง |

| เงื่อนไขการชำระเงิน: | ที/ที |

| สามารถในการผลิต: | จัดหาโดย Project/Batch |

|

ข้อมูลรายละเอียด |

|||

| สถานะผลิตภัณฑ์: | คลังสินค้า | แอปพลิเคชัน: | เซิร์ฟเวอร์ |

|---|---|---|---|

| ประเภทอินเทอร์เฟซ:: | Infiniband | พอร์ต: | คู่ |

| ความเร็วสูงสุด: | 100GBE | พิมพ์: | แบบมีสาย |

| เงื่อนไข: | ใหม่และเป็นต้นฉบับ | เวลารับประกัน: | 1 ปี |

| แบบอย่าง: | MCX653106A-ECAT | ชื่อ: | MCX653106A-ECAT Mellanox 100gb Nic ConnectX- 6 VPI Hdr100 Edr Ib สองพอร์ต |

| คำสำคัญ: | การ์ดเครือข่าย Mellanox | ||

| เน้น: | อะแดปเตอร์เครือข่าย Mellanox ConnectX-6,การ์ด Ethernet InfiniBand 100Gb/s,การ์ดเครือข่าย Mellanox แบบสองพอร์ต |

||

รายละเอียดสินค้า

การ์ดปรับปรุง InfiniBand และ Ethernet ที่มีความหลากหลายแบบ dual-port 100Gb/s พร้อมอินเตอร์เฟซ PCIe 3.0/4.0 x16 อนุญาต RDMA, NVMe-oF offload, การเข้ารหัสระดับบล็อกและคอมพิวเตอร์ในเครือข่ายสําหรับ HPC ที่ถูกปรับปรุงค่าใช้จ่าย, บริษัท และการจัดจําหน่ายเมฆ

- การเชื่อมต่อ InfiniBand 100Gb/s (EDR/HDR100) และ 100/50/40/25/10GbE

- PCIe Gen 3.0/4.0 x16 (เข้ากันได้ในระยะหลัง)

- การลดภาระของฮาร์ดแวร์: NVMe-oF เป้าหมาย/ผู้เริ่มต้น, การเข้ารหัส XTS-AES 256/512 บิต, MPI tag matching

- การสนับสนุน NVIDIA In-Network Computing และ GPUDirect RDMA

- ปัจจัยรูปแบบ PCIe แบบยืนระดับต่ํา, RoHS compliant

- ความเร็ว 100Gb/s:การทํางานที่พอร์ตสองแบบในความเร็วสูงสุด 100Gb/s InfiniBand (EDR/HDR100) หรือ Ethernet ด้วยความกว้างแบนด์วิถีสองทิศเต็ม

- การคิดเลขในเครือข่าย:ทําการทํางานรวม (MPI, NCCL, SHMEM) โดยใช้เทคโนโลยี NVIDIA SHARP

- การเข้ารหัสระดับบล็อก:แฮร์ดแวร์ AES-XTS 256/512 บิต การเข้ารหัส/ออกรหัส โดยไม่ต้องใช้ค่า CPU; สอดคล้องกับ FIPS

- NVMe-oF การปลดน้ํา:เป้าหมายและการเริ่มต้นการลดภาระสําหรับ NVMe ผ่าน Fabrics ลดการใช้ CPU

- การเวอร์ชูเอเลชั่นระดับสูง:SR-IOV ถึง 1K VFs, การเร่ง ASAP2 สําหรับ OVS และการสวิตชิ่งแบบแท้

MCX653106A-ECAT รวมNVIDIA In-Network Computing การคิดเลขในเครือข่ายเครื่องยนต์ (SHARP)RDMA (IBTA 1.3),RoCEและNVMe-oFมันรองรับPCIe Gen 4.0 (x16) และ Gen 30,PAM4 และ NRZ SerDes, และคุณสมบัติที่ระดับสูง เช่นการขนส่งที่เชื่อมโยงแบบไดนามิก (DCT),การเรียกใช้งานตามความต้องการ (ODP)และการปรับเปลี่ยนเส้นทาง. Overlay offloads สําหรับ VXLAN, NVGRE, Geneve ได้มีการเร่งคอมพิวเตอร์ สอดคล้องกับ IEEE 802.3bj, 802.3bm, 802.3by และ InfiniBand Trade Association.

ConnectX-6 เปลี่ยนงานการสื่อสารและการเก็บข้อมูลจาก CPU ที่เป็นเจ้าภาพไปยังฮาร์ดแวร์ของตัวปรับ (adapter) สําหรับ MPI คอลเลคทีฟ ตัวปรับจะประมวลผลข้อมูลในการขนส่งโดยใช้ SHARP โดยลดการจราจรของจุดปลายสําหรับการเก็บ, NVMe-oF คําสั่งถูกประมวลผลโดยตรงบนตัวปรับ, ปลดปล่อย CPU คอร์. การรหัส / การรหัสบล็อกเกิดขึ้นในสายที่ความเร็วสาย. ผลคือความช้าต่ํา, อัตราการส่งข้อความที่สูงกว่า (215 Mpps) และการปรับขนาดการใช้งานที่ดีขึ้นแม้แต่ความเร็ว 100Gb/s

- คลับ HPC ระยะกลางการจําลองที่ใช้ MPI ที่ต้องการการเชื่อมต่อกันที่ประหยัด 100Gb/s

- การสรุปและฝึกอบรม AI:คลัสเตอร์ GPU กับ GPUDirect RDMA และ NCCL

- การเก็บของ NVMe-oF:เป้าหมาย / เริ่มต้นการอํานวยความสะดวกสําหรับการเข้าถึงการเก็บข้อมูล NVMe ที่มีความสามารถสูง

- ศูนย์ข้อมูลเสมือน:SR-IOV และ ASAP2 สําหรับ OVS ลงโหลดใน NFV และเมฆ

- Enterprise Cloud: หน่วยงานการจัดการความเชื่อมต่อ Ethernet 100Gb สําหรับการเวอร์ชูเอล และการเข้าใกล้กันในการเก็บข้อมูล

| รุ่น | สนามบินและความเร็ว | อินเตอร์เฟซโฮสต์ | ปัจจัยรูปแบบ | การเข้ารหัส | โปรต็อกอล | OPN |

|---|---|---|---|---|---|---|

| ConnectX-6 | 2x QSFP56 (100Gb/s IB/Eth) | PCIe 3.0/4.0 x16 | PCIe stand-up (ระดับต่ํา) | AES-XTS 256/512 บิต | InfiniBand, Ethernet, NVMe-oF | MCX653106A-ECAT |

| ConnectX-6 | 1x QSFP56 (100Gb/s) | PCIe 4.0 x8 | การยืนของ PCIe | AES-XTS | IB/Eth | MCX651105A-EDAT |

| ConnectX-6 | 2x QSFP56 (200Gb/s) | PCIe 4.0 x16 | การยืนของ PCIe | AES-XTS | IB/Eth | MCX653106A-HDAT |

หมายเหตุ: MCX653106A-ECAT รองรับ InfiniBand 100Gb/s (EDR/HDR100) และ 100/50/25/10GbE. ขนาด: 167.65mm x 68.90mm (โดยไม่ใช้บราคเกต) รวมถึงบราคเกตสูง (อุปกรณ์เสริมบราคเกตสั้น)การบริโภคพลังงาน < 15W.

- VS ConnectX-5:ขนาดความกว้างของแบนด์บิดเพิ่มเป็นสองเท่า (100Gb/s เทียบกับ 50Gb/s) การบูรณาการ SHARP สําหรับการคํานวณในเครือข่าย และการเข้ารหัสระดับบล็อกโดยไม่เสียค่าใช้จ่ายเพิ่มเติม

- VS NICs ของผู้แข่งขันหน่วยงานการจัดหาของ NVMe-oF และ MPI จริงๆ ไม่ใช่แค่หน่วยงานการจัดหาที่ไม่มีรัฐ

- 100G ที่ถูกประหยัด:เหมาะสําหรับการสมดุลผลงานและงบประมาณในกลุ่มขนาดกลาง

- ความสอดคล้องกับ FIPSการเข้ารหัสของฮาร์ดแวร์ตรงกับมาตรฐานความปลอดภัยของรัฐบาล

เราให้บริการที่ปรึกษาทางเทคนิค 24/7 บริการ RMA และการสนับสนุนการบูรณาการสําหรับ ConnectX-6 adapters ทุกบัตรได้รับการสนับสนุนโดยการรับประกัน 1 ปี (สามารถขยายได้)ทีมงานของเราให้การรับรอง Driver สําหรับการจําหน่าย Linux หลักๆ, Windows และ VMware มีการสนับสนุนการตั้งค่าก่อนการขายสําหรับการออกแบบผ้า InfiniBand / Ethernet

Q: MCX653106A-ECAT สามารถใช้สวิตช์ควอนตัม 200Gb/s ได้หรือไม่?

A:ใช่, มันสามารถทํางานร่วมกันได้กับสวิตช NVIDIA Quantum QM8700/QM8790 เมื่อใช้โหมด HDR100 (100Gb/s ต่อพอร์ต)

คําถาม: ตัวปรับตัวนี้สามารถใช้ได้สําหรับ Ethernet และ InfiniBand?

A:ใช่ มันรองรับโปรโตคอล InfiniBand และ Ethernet ทั้งคู่ แฟร์มแวร์จะตรวจจับชนิดสวิตช์โดยอัตโนมัติ และตั้งค่าโหมดที่เหมาะสม

ถาม: มันรองรับ RoCE (RDMA over Converged Ethernet) ไหม?

A:ใช่, ConnectX-6 รองรับ RoCE อย่างเต็มที่, ให้ RDMA ความยืดหยุ่นต่ําในสภาพแวดล้อม Ethernet.

Q: อัตราการส่งข้อความสูงสุดเท่าไร?

A:ตัวปรับส่งส่งถึง 215 ล้านข้อความต่อวินาที เหมาะสําหรับภาระงาน HPC แพคเก็ตขนาดเล็ก

คําถาม: การ์ดสามารถใช้สล็อต PCIe Gen 3.0 ได้หรือไม่?

A:ใช่, มันเข้ากันได้อย่างเต็มที่กับสล็อต PCIe Gen 3.0 x16; ผลงานจะจํากัดกับ ~ 100Gb / s รวม, ซึ่งตรงกับความเร็วของพอร์ต.

- ความต้องการของช่อง PCIe:เพื่อให้มีผลงานที่ดีที่สุด ติดตั้งในช่อง PCIe Gen 3.0 x16 หรือ Gen 4.0 x8/x16

- การเย็น:รับประกันการไหลของอากาศที่เหมาะสมในเซอร์เวอร์ชัสซี; การเย็นแบบปาสิฟ จําเป็นต้องมีความต่ํา 200 LFM

- การเชื่อมต่อสายไฟ:ใช้ QSFP56 พันธมิตร / กระตุ้น หรือโมดูลออปติกส์ที่ระดับ 100Gb/s (EDR/HDR100)

- การสนับสนุนคนขับ:ใช้ NVIDIA MLNX_OFED ล่าสุดสําหรับ Linux หรือ WinOF-2 สําหรับ Windows

- อุณหภูมิการทํางาน0 °C ถึง 70 °C; เก็บไว้ระหว่าง -40 °C และ 85 °C

ด้วยประสบการณ์มากกว่าสิบปี เราดําเนินงานโรงงานขนาดใหญ่ ที่ได้รับการสนับสนุนจากทีมงานเทคนิคที่แข็งแรงฐานลูกค้าและความเชี่ยวชาญในกลุ่มที่กว้างใหญ่ของเรา ทําให้เราสามารถนําเสนอราคาที่แข่งขันได้ โดยไม่เสียสละคุณภาพในฐานะผู้จําหน่ายที่ได้รับอนุญาตสําหรับ Mellanox, Ruckus, Aruba และ Extreme เรามีสวิตช์เครือข่ายเดิม, การ์ดเครือข่าย (nic card)เราเก็บสินค้าได้ถึง 10 ล้านดอลลาร์ เพื่อให้การจัดซื้อสินค้าได้อย่างรวดเร็วทุกการส่งสินค้าจะถูกตรวจสอบให้ถูกต้อง และเราให้คําปรึกษาและการสนับสนุนทางเทคนิคตลอด 24 ชั่วโมงทีมงานขายและเทคนิคมืออาชีพของเราได้รับชื่อเสียงสูงในตลาดโลก.