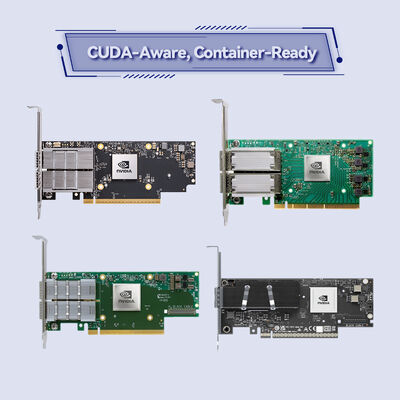

NVIDIA MCX555A-ECAT 100Gb/s Single-Port QSFP28 InfiniBand Adapter PCIe 3.0 x16 ConnectX-5 การ์ดเครือข่าย

รายละเอียดสินค้า:

| ชื่อแบรนด์: | Mellanox |

| หมายเลขรุ่น: | MCX555A-ECAT |

| เอกสาร: | CONNECTX-5 infiniband.pdf |

การชำระเงิน:

| จำนวนสั่งซื้อขั้นต่ำ: | 1 ชิ้น |

|---|---|

| ราคา: | Negotiate |

| รายละเอียดการบรรจุ: | กล่องด้านนอก |

| เวลาการส่งมอบ: | ขึ้นอยู่กับสินค้าคงคลัง |

| เงื่อนไขการชำระเงิน: | ที/ที |

| สามารถในการผลิต: | จัดหาโดย Project/Batch |

|

ข้อมูลรายละเอียด |

|||

| สถานะผลิตภัณฑ์: | คลังสินค้า | แอปพลิเคชัน: | เซิร์ฟเวอร์ |

|---|---|---|---|

| เงื่อนไข: | ใหม่และเป็นต้นฉบับ | พิมพ์: | แบบมีสาย |

| ความเร็วสูงสุด: | EDR และ 100GBE | ตัวเชื่อมต่ออีเธอร์เน็ต: | QSFP28 |

| เน้น: | NVIDIA ConnectX-5 อัดแปลง InfiniBand,การ์ดเครือข่าย 100Gb/s QSFP28,การ์ด PCIe 3.0 x16 Mellanox |

||

รายละเอียดสินค้า

แอดป์เตอร์เครือข่าย 100Gb/s ที่มีความสามารถสูงและความช้าต่ํา ที่ถูกออกแบบมาสําหรับ HPC, AI และศูนย์ข้อมูลในเมฆและ tag matching สําหรับภาระงาน MPI.

รายการNVIDIA ConnectX-5 MCX555A-ECATเป็นการ์ดปรับปรุง InfiniBand 100Gb / s ที่มีพอร์ตเดียวในรูปแบบ PCIe ขนาดต่ําความเร็ว 100Gb/sด้วยความช้าต่ํากว่าไมโครเซกอนด์และอัตราการส่งข้อความสูง การ์ดรองรับทั้ง InfiniBand (จนถึง EDR) และ 100GbE, ให้ความเชื่อมโยงที่หลากหลายสําหรับคอมพิวเตอร์ประสิทธิภาพสูง,และสภาพแวดล้อมเสมือน.

สร้างขึ้นด้วยสวิตช์ PCIe ที่ติดตั้งและความสามารถ RDMA ที่ก้าวหน้า MCX555A-ECAT ทําหน้าที่การสื่อสารที่สําคัญจาก CPUการบริโภคพลังงานที่ต่ํากว่า, และลดต้นทุนการครอบครองทั้งหมด. มันเข้ากันได้อย่างสมบูรณ์แบบกับสล็อต PCIe 3.0 x16 และรองรับระบบปฏิบัติการและกรอบเร่งที่หลากหลาย

- สูงสุด 100Gb/sความเชื่อมต่อต่อต่อพอร์ต (InfiniBand EDR / 100GbE)

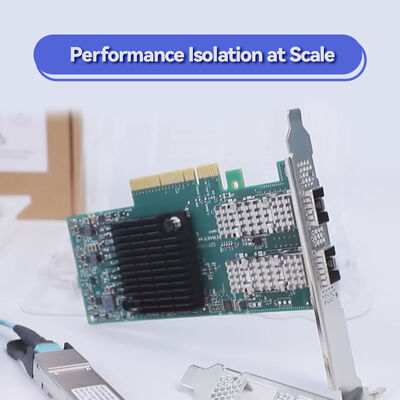

- เครื่องเชื่อม QSFP28 ตัวเดียวสําหรับสายไฟฟ้าออปติกหรือสายทองแดง

- PCIe 3.0 x16 อินเตอร์เฟซโฮสต์(การต่อรองอัตโนมัติ x8, x4, x2, x1)

- RDMA, ส่ง/รับ semanticsด้วยการขนส่งที่น่าเชื่อถือโดยใช้ฮาร์ดแวร์

- การสอดคล้องการติดป้ายและการพบกันของสินค้าสําหรับ MPI และ SHMEM

- NVMe over Fabrics (NVMe-oF) เป้าหมายการลดน้ําหนักสําหรับการเก็บรักษาที่ประสิทธิภาพ

- GPUDirect RDMA (PeerDirect)การเร่งสําหรับการสื่อสาร GPU

- การควบคุมความหนาแน่นที่ใช้ฮาร์ดแวร์ และการสนับสนุนการทําเส้นทางแบบปรับปรุง

- การเวอร์ชูเอล SR-IOV:สูงสุด 512 ฟังก์ชันเสมือน

- RoHS ที่สอดคล้องกับปัจจัยรูปร่างแบบต่ํา(รวมกั้นความสูง)

สถาปัตยกรรม ConnectX-5 มีเครื่องยนต์เร่งฮาร์ดแวร์หลายแบบที่ช่วยลดการเข้ามือของ CPU และเพิ่มความสามารถในการปรับขนาดของแอปพลิเคชั่น:

- MPI Tag Matching & Rendezvous Offload: แท็กที่ตรงกันและการพบกันทําให้การประมวลผลข้อความที่ตรงกับข้อความ และโปรโตคอล rendezvous ได้ดีขึ้นอย่างมาก

- RDMA ออท-ออเดอร์กับการนําทางแบบปรับปรุงทําให้สามารถใช้งานได้อย่างมีประสิทธิภาพของเส้นทางเครือข่ายหลายเส้นทาง ในขณะที่ยังคงรักษาความเรียบร้อยการเสร็จสิ้น semantics, ยิ่งการใช้งานผ้า.

- NVMe-oF เป้าหมายลดภาระอํานวยความสะดวกให้ระบบการเก็บข้อมูล NVMe ให้บริการการเข้าถึงทางไกลด้วย CPU overhead เกือบศูนย์ เหมาะสําหรับสถาปัตยกรรมการเก็บข้อมูลที่แยกแยก

- การขนส่งที่เชื่อมโยงแบบไดนามิก (DCT):ให้ความสามารถในการปรับขนาดสูงสุดสําหรับระบบคอมพิวเตอร์และระบบเก็บข้อมูลขนาดใหญ่ โดยกําจัดค่าใช้จ่ายในการตั้งค่าการเชื่อมต่อ

- ASAP2 การสวิตชิ่งและการประมวลผลแพ็คเก็ตที่เร่งรัดการลดความอึดอัดของฮาร์ดแวร์สําหรับ Open vSwitch (OVS) และการหล่อล้างเครือข่าย (VXLAN, NVGRE, GENEVE)

- การเรียกใช้งานตามความต้องการ (ODP):รองรับการพิจารณาความจําเสมือนสําหรับการดําเนินงาน RDMA ทําให้การพัฒนาแอปพลิเคชั่นง่ายขึ้น

- คอมพิวเตอร์ประสิทธิภาพสูง (HPC)เหมาะสําหรับคลาสเตอร์ซูเปอร์คอมพิวเตอร์, การจําลองแบบ MPI และภาระงานวิจัยวิทยาศาสตร์ที่ต้องการความช้าต่ําและอัตราการส่งข้อความสูง

- AI & Deep Learning การฝึกอบรม:รวมกับ GPUDirect RDMA ทําให้การสื่อสาร GPU-to-GPU ผ่านหน่วยได้รวดเร็ว เร่งเวลาการฝึกอบรม

- ระบบเก็บข้อมูล NVMe-oF:ใช้เป็นเป้าหมายในการเก็บข้อมูลหรือผู้เริ่มต้นใน NVMe ผ่านสภาพแวดล้อม Fabrics เพื่อการเข้าถึงการเก็บข้อมูลแบบบล็อกที่มีความเร็วสูงและความช้าน้อย

- คลู๊ด & ศูนย์ข้อมูลเสมือน:SR-IOV และการอํานวยความสะดวกจากการเสมือน (virtualization offloads) รองรับสภาพแวดล้อมหลายตัวจ้างที่มีการรับประกัน QoS และการแยกตัวอย่างปลอดภัย

- การซื้อขายความถี่สูง (HFT):ความยืดหยุ่นที่ต่ํามากและการตราเวลาของฮาร์ดแวร์ (IEEE 1588v2) ตอบสนองความต้องการของแอพลิเคชั่นบริการการเงิน

MCX555A-ECAT ได้ถูกออกแบบมาเพื่อความสอดคล้องอย่างกว้างขวางกับสวิตช์ NVIDIA InfiniBand (เช่น Quantum, Spectrum) และสวิตช์ 100GbE ของผู้บริการที่มาจากฝ่ายที่สามมันรองรับทั้ง DAC ทองแดงปัสสิฟและสายไฟฟ้าออทติคที่ทํางานผ่าน Port QSFP28.

ระบบปฏิบัติการและซอฟต์แวร์สเต็ก

- RHEL / CentOS, Ubuntu, วินโดว์เซอร์เวอร์, FreeBSD, VMware ESXi

- OpenFabrics Enterprise Distribution (OFED) / WinOF-2

- NVIDIA HPC-X, OpenMPI, MVAPICH2, Intel MPI, แพลตฟอร์ม MPI

- Data Plane Development Kit (DPDK) สําหรับการเลี่ยงคอร์เนล

| ปริมาตร | รายละเอียด |

|---|---|

| รุ่น | MCX555A-ECAT |

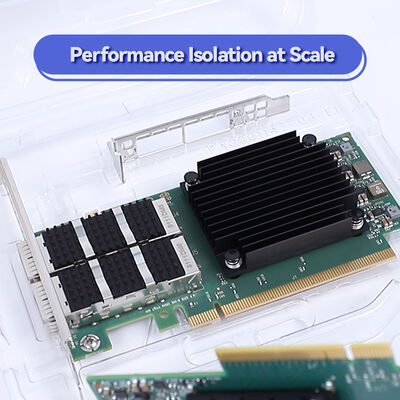

| ปัจจัยรูปแบบ | PCIe Low-Profile (14.2cm x 6.9cm โดยไม่ใช้คอรเกต) คอรเกตสูงติดตั้งล่วงหน้า คอรเกตสั้นรวม |

| ความเร็วและประเภทพอร์ต | 1x QSFP28 สูงสุด 100Gb/s InfiniBand (EDR) และ 100GbE |

| อินเตอร์เฟซโฮสต์ | PCI Express 3.0 x16 (เข้ากันได้กับ x8, x4, x2, x1) |

| รองรับ InfiniBand | สอดคล้องกับ IBTA 1.3 EDR 100Gb/s, FDR, QDR, DDR, SDR; 8 เส้นทางเสมือน + VL15; 16 ล้านช่องทาง I/O |

| การสนับสนุน Ethernet | 100GbE, 50GbE, 40GbE, 25GbE, 10GbE, 1GbE; IEEE 802.3cd, 802.3bj, 802.3by, 802.3ba, 802.3ae |

| ความสามารถ RDMA | RDMA over Converged Ethernet (RoCE) การขนส่งที่เชื่อถือได้ด้วยฮาร์ดแวร์ RDMA นอกระบบ การปฏิบัติงานอะตอม |

| การเก็บเก็บของ | NVMe ผ่าน Fabrics เป้าหมายการลด, iSER, SRP, NFS RDMA, SMB Direct, T10 DIF การส่งลายเซ็นต์ |

| การเวอร์ชูเอเลชั่น | SR-IOV (สูงสุด 512 ฟังก์ชันเสมือน) VMware NetQueue NPAR PCIe Access Control Services (ACS) |

| CPU Offloads | TCP/UDP/IP stateless offload, LSO/LRO, checksum offload, RSS/TSS, VLAN/MPLS การใส่/ถอด tag |

| เครือข่ายที่ครอบคลุม | การลดความแรงของฮาร์ดแวร์สําหรับ VXLAN, NVGRE, GENEVE encapsulation/decapsulation |

| การบริหาร | NC-SI ผ่าน MCTP PLDM สําหรับจอ/ควบคุม และอัพเดทฟอร์มแวร์ I2C SPI JTAG |

| Remote Boot | การเริ่มต้นทางไกลผ่าน InfiniBand, Ethernet, iSCSI; การสนับสนุน UEFI, PXE |

| การบริโภคพลังงาน | ไม่ถูกระบุเป็นสาธารณะ ระยะเฉพาะต่ํากว่า 20W |

| อุณหภูมิการทํางาน | 0°C ถึง 55°C (สภาพแวดล้อมทั่วไป) |

| ความสอดคล้อง | RoHS, REACH, FCC, CE, VCCI, ICES, RCM |

หมายเหตุ: รายละเอียดมาจากเอกสารผลิตภัณฑ์ NVIDIA ConnectX-5. สําหรับรายละเอียดล่าสุดและการสนับสนุนฟอร์มแวร์, ดูหมายเหตุการปล่อยอย่างเป็นทางการของ NVIDIA.

| เลขของชิ้นสั่งซื้อ | สนามบิน / ความเร็ว | อินเตอร์เฟซโฮสต์ | ปัจจัยรูปแบบ | ลักษณะสําคัญ |

|---|---|---|---|---|

| MCX555A-ECAT | 1x QSFP28, 100Gb/s | PCIe 3.0 x16 | PCIe ขนาดต่ํา | สายพานเดียวแบบมาตรฐาน EDR InfiniBand / 100GbE |

| MCX556A-ECAT | 2x QSFP28, 100Gb/s | PCIe 3.0 x16 | PCIe ขนาดต่ํา | โปรแกรมการใช้งาน |

| MCX556A-EDAT | 2x QSFP28, 100Gb/s | PCIe 4.0 x16 | PCIe ขนาดต่ํา | ConnectX-5 Ex พัฒนา PCIe Gen4 |

| MCX556M-ECAT-S25 | 2x QSFP28, 100Gb/s | 2x PCIe 3.0 x8 | ซ็อคเกต ดิเร็คต์ | การเชื่อมต่อเซอร์เวอร์แบบสองซ็อคเก็ต ผ่านสายลม |

| MCX545B-ECAN | 1x QSFP28, 100Gb/s | PCIe 3.0 x16 | OCP 2.0 ประเภท 1 | ปัจจัยรูปแบบโครงการ Open Compute |

สําหรับตัวแปร OCP หรือ Multi-Host กรุณาติดต่อขาย ทุกการ์ดรองรับความสอดคล้องแบบถอยหลังเพื่อความเร็วต่ํากว่า

- ผลงานการใช้งานที่ดีกว่าแฮร์ดแวร์อัพโหลดสําหรับ MPI, NVMe-oF, และอัพโหลด CPU core ฟรีสําหรับโลจิกธุรกิจ

- ผ้า RDMA ที่สามารถปรับขนาดได้:DCT, XRC และ RDMA นอกลําดับให้ความสามารถในการปรับขนาดเชิงเส้นสําหรับหน่วยพันๆ.

- GPU เร่งพร้อม:GPUDirect RDMA ทําให้การเข้าถึงความจําโดยตรงระหว่าง GPU และตัวปรับเครือข่ายสามารถกําจัดความคับของ CPU ใน AI cluster ได้

- การใช้งานแบบยืดหยุ่นท่าเรือ QSFP28 ตัวเดียวทําให้การติดสายง่ายขึ้นและเหมาะสําหรับสถาปัตยกรรมกระดูกสันหลังใบ 100Gb / s

- การคุ้มครองการลงทุนการสนับสนุนทั้ง InfiniBand และ Ethernet ทําให้มีการเปลี่ยนระหว่างโปรโตคอลได้อย่างต่อเนื่องตามความต้องการ

กลุ่มฮ่องกง Starsurge ให้การสนับสนุนวงจรชีวิตครบวงจรสําหรับ NVIDIA ConnectX-5 adapters รวมถึงการสนับสนุนการตั้งค่าก่อนการขาย การแนะนําการอัพเดทฟอร์มแวร์ และบริการรับประกันทีมงานเทคนิคของเราสามารถช่วยคุณ:

- การตรวจสอบความสอดคล้องกับเซอร์เวอร์และโครงสร้างสวิตช์ของคุณ

- การปรับประสิทธิภาพสําหรับ HPC หรือภาระการทํางานในการเก็บ

- ตัวเลือกการจัดเก็บพัสดุตามความต้องการ และความต้องการในการบรรจุพัสดุแบบสับซ้อน

- บริการประมวลผล RMA และบริการแทนที่ระดับสูง

ติดต่อวิศวกรขายของเรา สําหรับราคาปริมาณและเวลานําข้อมูล

อุปกรณ์อิเล็กทรอนิกส์:ใช้มาตรการ ESD-Safe ทุกครั้งเมื่อการจัดการกับตัวปรับความต้องการในการเย็น:ให้แน่ใจว่ามีการไหลของอากาศที่เพียงพอในเซอร์เวอร์เชสซี่ เพื่อรักษาอุณหภูมิการทํางานในช่วงที่กําหนดไว้อัพเดทฟอร์มแวร์:ใช้เครื่องมือฟอร์มแวร์อย่างเป็นทางการของ NVIDIA (MFT) และตรวจสอบความสอดคล้องกับระบบปฏิบัติการและรุ่นไดรเวอร์ของคุณก่อนการอัพเดทการบิดเคเบิล:ติดตามแนวทางระยะโค้งสาย QSFP28 เพื่อหลีกเลี่ยงการเสื่อมของสัญญาณ

นี่คือสินค้าประเภท A ในสภาพแวดล้อมที่อยู่อาศัย มันอาจทําให้เกิดการรังสีรังสี

สร้างขึ้นในปี 2008บริษัท ฮ่องกง สตาร์สอร์จ กรุ๊ป จํากัดเป็นผู้ให้บริการด้านอุปกรณ์เครือข่าย บริการไอที และการบูรณาการระบบที่พัฒนาโดยเทคโนโลยี บริการลูกค้าทั่วโลกด้วยสินค้ารวมถึงสวิทช์เครือข่าย NICs จุดการเข้าถึงไร้สายเครื่องควบคุมบริษัทสตาร์สอร์จรวมความเชี่ยวชาญทางเทคนิคที่ลึกซึ้งกับวิธีการที่ลูกค้าเป็นอันดับแรก บริษัทสนับสนุนอุตสาหกรรม เช่นรัฐบาล, การดูแลสุขภาพ, การผลิต, การศึกษา, การเงิน,และธุรกิจ โดยนําเสนอการแก้ไข IoT ระบบจัดการเครือข่าย การพัฒนาโปรแกรมตามสั่ง และการจัดส่งทั่วโลกหลายภาษา โดยเน้นการให้บริการที่มีคุณภาพที่น่าเชื่อถือและตอบสนองสตาร์สอร์จช่วยลูกค้า สร้างความประสิทธิภาพ, โครงสร้างระบบเครือข่ายที่สามารถปรับขนาดได้ และเชื่อถือได้

| องค์ประกอบ / ระบบ | สถานะความเข้ากัน | หมายเหตุ |

|---|---|---|

| NVIDIA Quantium InfiniBand Switches เครื่องเปลี่ยน | รับรอง | ความเหมาะสม EDR, HDR เมื่อใช้ฟอร์มแวร์ที่เหมาะสม |

| NVIDIA Spectrum Ethernet Switches เครื่องปรับเปลี่ยน | รับรอง | รูปแบบ 100GbE, 50GbE, 25GbE รองรับ |

| เครื่องสวิทช์ 100GbE ของผู้บริหารฝ่ายที่สาม | รองรับได้ | จําเป็นต้องสอดคล้องกับมาตรฐาน IEEE; ทดสอบกับผู้ขายหลัก |

| เซอร์เวอร์ GPU (NVIDIA DGX, HGX) | รับรองด้วย GPUDirect | การเร่ง RDMA สําหรับการสื่อสารหลาย GPU |

| เครื่องเก็บข้อมูลที่มี NVMe-oF | การสนับสนุน | การลดความอ้วนของเป้าหมายทําให้การเข้าถึงผ้า NVMe ได้อย่างมีประสิทธิภาพ |

- ✓ ยืนยันว่าเซอร์เวอร์มีสล็อต PCIe 3.0 x16 (หรือ x8) ที่มีความว่างพอเพียง

- ✓ กําหนดจํานวนท่าทาง: ท่าทางเดียว (MCX555A-ECAT) vs ท่าทางสอง (MCX556A-ECAT)

- เลือกชนิดเคเบิล: DAC ทองแดงปานกลางสําหรับระยะทางสั้น (≤5m) หรือแสงสําหรับระยะทางยาว

- ตรวจสอบระบบปฏิบัติการและการสนับสนุน Driver (OFED, Windows, VMware)

- สําหรับ GPU คลัสเตอร์, ให้แน่ใจว่า GPUDirect RDMA เป็นความสอดคล้องกับรุ่น GPU และรุ่น Driver ของคุณ.

- ตรวจสอบว่า ราคาบราคเก็ตสูงหรือสั้นที่ต้องการสําหรับเซอร์เวอร์ของคุณ

- NVIDIA MCX556A-ECAT อัดแปลง ConnectX-5 แบบสองพอร์ต 100Gb/s

- NVIDIA MCX556A-EDAT ConnectX-5 Ex พร้อมการสนับสนุน PCIe 4.0

- NVIDIA Quantum-2 QM9700 สวิตช์อินฟินินีแบนด์ขนาด 40 ท่า 800Gb/s

- สายไฟ DAC แบบเฉียบพลัน Mellanox QSFP28 (1m,2m,3m)

- NVIDIA Spectrum-4 SN5600 100GbE/400GbE เครื่องสวิทช์เอเธิร์น

- NVIDIA ConnectX-5 InfiniBand Adapter Card คู่มือการใช้งาน

- RDMA over Converged Ethernet (RoCE) คู่มือการใช้งาน

- GPUDirect RDMA แนวปฏิบัติที่ดีที่สุดสําหรับ AI Cluster

- NVMe ผ่าน Fabrics กับ ConnectX-5 คู่มือการตั้งค่า

- คู่มือการติดตั้งและการปรับปรุง OFED