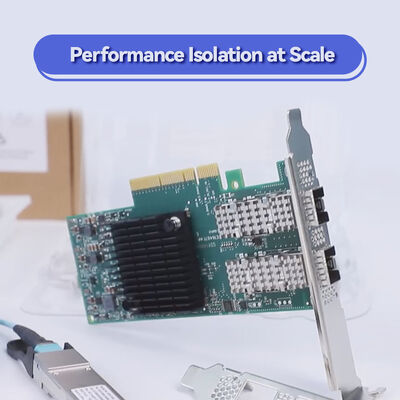

NVIDIA ConnectX-6 MCX653105A-HDAT 200Gb/s Single-Port InfiniBand Smart Adapter พร้อมการเข้ารหัสฮาร์ดแวร์และ PCIe 40

รายละเอียดสินค้า:

| ชื่อแบรนด์: | Mellanox |

| หมายเลขรุ่น: | MCX653105A-HDAT |

| เอกสาร: | connectx-6-infiniband.pdf |

การชำระเงิน:

| จำนวนสั่งซื้อขั้นต่ำ: | 1 ชิ้น |

|---|---|

| ราคา: | Negotiate |

| รายละเอียดการบรรจุ: | กล่องด้านนอก |

| เวลาการส่งมอบ: | ขึ้นอยู่กับสินค้าคงคลัง |

| เงื่อนไขการชำระเงิน: | ที/ที |

| สามารถในการผลิต: | จัดหาโดย Project/Batch |

|

ข้อมูลรายละเอียด |

|||

| สถานะผลิตภัณฑ์: | คลังสินค้า | แอปพลิเคชัน: | เซิร์ฟเวอร์ |

|---|---|---|---|

| เงื่อนไข: | ใหม่และเป็นต้นฉบับ | พิมพ์: | แบบมีสาย |

| ความเร็วสูงสุด: | สูงถึง 200 gb/s | ตัวเชื่อมต่ออีเธอร์เน็ต: | QSFP56 |

| แบบอย่าง: | MCX653105A-HDAT | ||

| เน้น: | NVIDIA ConnectX-6 อัดแปลง Infiniband,การ์ดเครือข่าย 200Gb/s PCIe 4.0,อัดแปลง InfiniBand ด้วยการเข้ารหัสด้วยฮาร์ดแวร์ |

||

รายละเอียดสินค้า

200Gb/s Single-Port HDR Smart Adapter พร้อมคอมพิวเตอร์ในเครือข่ายและการเข้ารหัสฮาร์ดแวร์

NVIDIA ConnectX-6MCX653105A-HDATส่งการผ่านเต็ม 200Gb / s บนพอร์ต QSFP56 เดียว, รวมความช้าต่ําสุด, การลดภาระของฮาร์ดแวร์, และการเข้ารหัส XTS-AES ระดับบล็อก. ออกแบบสําหรับ HPC, คลัสเตอร์ AI และการเก็บข้อมูล NVMe-oF,PCIe 4 นี้.0 x16 แอดป์เตอร์ลดโหลดการประกอบการรวม RDMA และการเข้ารหัสจาก CPU ทําให้การทํางานของแอปพลิเคชั่นและความสามารถในการปรับขนาดได้สูงที่สุดในสภาพแวดล้อมของศูนย์ข้อมูลที่ต้องการ

รายการMCX653105A-HDATเป็นส่วนหนึ่งของครอบครัว NVIDIA ConnectX-6 InfiniBand adapter ที่ออกแบบมาเพื่อการทํางานที่สูงสุดในศูนย์ข้อมูลที่ทันสมัย200Gb/s(HDR InfiniBand หรือ 200GbE) ด้วยการเร่งกระบวนการฮาร์ดแวร์เต็มสําหรับ RDMA, การขนส่งที่น่าเชื่อถือ, และคอมพิวเตอร์ในเครือข่ายและ NVMe มากกว่าความเร่ง Fabrics, แอดป์เตอร์ลดค่าใช้จ่ายของ CPU ได้อย่างมากในขณะที่เพิ่มประสิทธิภาพของผ้า. การเข้ารหัสระดับบล็อก AES-XTS ของมันที่สร้างขึ้นทําให้มันเหมาะสมสําหรับบริการทางการเงิน, การวิจัยของรัฐบาล และการจัดจําหน่ายเมฆขนาดใหญ่

ถึง 200Gb/s (HDR InfiniBand / 200GbE) บน QSFP56 ตัวเดียว

สูงสุด 215 ล้านข้อความ/วินาที

ระดับบล็อก XTS-AES 256/512 บิต สอดคล้องกับ FIPS

การลดภาระรวม NVMe-oF เป้าหมาย/การลดภาระเริ่มต้น

PCIe Gen 4.0 / 3.0 x16 (เข้ากันได้ในระยะหลัง)

SR-IOV (1K VFs), ASAP2, เปิด vSwitch ถอนน้ําหนัก, หลุมลอย

RoCE, XRC, DCT, On-Demand Paging, การสนับสนุน RDMA โดย GPUDirect

PCIe ข้างยืนมีโปรไฟล์ต่ํา มีพับสูงติดตั้งก่อน + พับสั้นรวม

NVIDIA ConnectX-6 รวมคอมพิวเตอร์ในเครือข่ายเครื่องยนต์เร่งที่ลดภาระการดําเนินงานของศูนย์ข้อมูลที่สําคัญจาก CPU เจ้าภาพ MCX653105A-HDAT รองรับการขนส่งที่น่าเชื่อถือโดยใช้ฮาร์ดแวร์, การตั้งทางแบบปรับปรุง และการควบคุมความจุกจุกการประกันผลงานที่คาดเดาได้ในผ้าขนาดใหญ่.การเข้าถึงความจําทางไกลโดยตรง (RDMA)ทําให้การถ่ายทอดข้อมูลไม่มีสําเนา โดยเลี่ยงเนอร์เนลของระบบปฏิบัติการNVIDIA GPUDirect RDMA, แมมมรี่ GPU สื่อสารโดยตรงกับตัวปรับเครือข่าย, ลดความช้าสําหรับการฝึกอบรม AI และ HPCการเข้ารหัส XTS-AES ระดับบล็อก(256/512-bit key) รับประกันความปลอดภัยของข้อมูลในระหว่างการขนส่งและข้อมูลที่พัก โดยไม่มีค่าใช้จ่ายส่วนกลางของ CPU และตัวปรับแต่งถูกออกแบบมาเพื่อตอบสนองความต้องการตาม FIPS 140-2

- คอมพิวเตอร์ประสิทธิภาพสูง (HPC)การจําลองขนาดใหญ่, การคาดการณ์สภาพอากาศ, และการคํานวณไดนามิกของสารเหลวที่ต้องการ 200Gb / s การเชื่อมต่อกันความช้าต่ํา

- AI & Deep Learning คลัสเตอร์:การฝึกกระจายด้วย GPUDirect RDMA เพิ่มความเร็วระหว่าง GPU

- ระบบเก็บข้อมูล NVMe-oF:ความสามารถในการเก็บข้อมูลที่แยกแยกได้สูง ด้วยการลดอัตราของเป้าหมาย / เครื่องเริ่มต้นอย่างเต็มที่ ลดการใช้ CPU

- ศูนย์ข้อมูลไฮเปอร์สเกลและคลาวด์บรรยากาศเสมือนด้วย SR-IOV, เครือข่ายออเวเรย์ และการเข้ารหัสที่เร่งด้วยฮาร์ดแวร์

- แพลตฟอร์มการค้าทางการเงินเครือข่ายที่กําหนดความช้าต่ําสุด สําหรับการเทรดแบบอัลการิทึม

ConnectX-6 MCX653105A-HDAT สามารถทํางานร่วมกันได้อย่างต่อเนื่องกับสวิตช์ NVIDIA Quantum InfiniBand (HDR 200Gb/s) สวิตช์ 200GbE มาตรฐาน และแพลตฟอร์มเซอร์เวอร์ที่หลากหลายมันรองรับระบบปฏิบัติการหลักและ virtual stackการประกันความยืดหยุ่นในการบูรณาการในพื้นฐานที่มีอยู่

| ปริมาตร | รายละเอียด |

|---|---|

| รูปแบบสินค้า | MCX653105A-HDAT |

| อัตราข้อมูล | 200Gb/s, 100Gb/s, 50Gb/s, 40Gb/s, 25Gb/s, 10Gb/s, 1Gb/s (InfiniBand และ Ethernet) |

| Port และ Connector | 1x QSFP56 (สนับสนุนสายทองแดงแบบปาซีฟิค, ไฮโลออฟติก และสาย AOC) |

| อินเตอร์เฟซโฮสต์ | PCIe Gen 4.0 x16 (ยังเข้ากันได้กับ Gen 3.0, 2.0; รองรับการตั้งค่า x8, x4, x2, x1) |

| ความช้า | ช่วงเวลาใต้ไมโครเซกอนด์ (ทั่วไป < 0.7μs) |

| อัตราข้อความ | ถึง 215 ล้านข้อความต่อวินาที |

| การเข้ารหัส | XTS-AES 256/512 บิต การถอนฮาร์ดแวร์ FIPS 140-2 พร้อม |

| ปัจจัยรูปแบบ | เครื่องยืนแบบ PCIe ขนาดต่ํา (ติดตั้งไว้ก่อนด้วยพัสดุพัสดุพัสดุพัสดุสูง พร้อมอุปกรณ์เสริมพัสดุพัสดุสั้น) |

| ขนาด (ไม่รวมกั้น) | 167.65 มิลลิเมตร x 68.90 มิลลิเมตร |

| การบริโภคพลังงาน | ประจํา 22W ∙ 24W (ขึ้นอยู่กับการใช้งานสาย) |

| การเวอร์ชูเอเลชั่น | SR-IOV (สูงสุด 1K Virtual Functions), VMware NetQueue, NPAR, ASAP2 การลดอัตราการไหล |

| การบริหารและการติดตาม | NC-SI, MCTP ผ่าน PCIe/SMBus, PLDM (DSP0248, DSP0267), I2C, SPI แฟลช |

| Remote Boot | InfiniBand, iSCSI, PXE, UEFI |

| ระบบปฏิบัติการ | RHEL, SLES, Ubuntu, Windows Server, FreeBSD, VMware vSphere, OpenFabrics Enterprise Distribution (OFED), WinOF-2 |

| เลขของชิ้นสั่ง (OPN) | ท่าเรือ | ความเร็วสูงสุด | อินเตอร์เฟซโฮสต์ | ลักษณะสําคัญ |

|---|---|---|---|---|

| MCX653105A-HDAT | 1x QSFP56 | 200Gb/s | PCIe 3.0/4.0 x16 | โพร์ตเดียว, แฮร์ดแวร์คริปโต้, การออกโหลด ConnectX-6 อย่างเต็มที่, เหมาะสําหรับเซอร์เวอร์ความหนาแน่นสูง |

| MCX653106A-HDAT | 2x QSFP56 | 200Gb/s (โพร์ตสอง) | PCIe 3.0/4.0 x16 | โพร์ตสองสาย 200Gb/s กับ crypto ความหนาแน่นของแบนด์วิทสูงสุด |

| MCX653105A-ECAT | 1x QSFP56 | 100Gb/s | PCIe 3.0/4.0 x16 | ท่าทางเดียว 100Gb/s ปรับปรุงค่าใช้จ่ายเพื่อความต้องการความเร็วต่ํากว่า |

| MCX653106A-ECAT | 2x QSFP56 | 100Gb/s ( dual-port) | PCIe 3.0/4.0 x16 | โพร์ตสองสาย 100Gb / s, การเสมือนและการเก็บของ |

| MCX653436A-HDAT (OCP 3.0) | 2x QSFP56 | 200Gb/s | PCIe 3.0/4.0 x16 | OCP 3.0 small form factor, dual-port 200Gb/s |

- ความกว้างแบนด์เบดเต็ม 200Gb / s:การออกแบบพอร์ตเดียวจะให้ผลิตความเร็วสูงสุดสําหรับคอมพิวเตอร์โน๊ด ที่มีความหนาแน่นสูงต่อพอร์ตเป็นอันดับหนึ่ง

- การรักษาความปลอดภัยของฮาร์ดแวร์การเข้ารหัสบล็อก XTS-AES โดยไม่ต้องใช้ค่า CPU ที่ตรงกับ FIPS สําหรับอุตสาหกรรมที่ถูกกําหนด

- การรวดเร็วในการเก็บข้อมูลและ AI:NVMe-oF offloads และ GPUDirect RDMA เพิ่มผลงานในการฝึกอบรม AI และการเก็บข้อมูลที่กําหนดด้วยซอฟต์แวร์ขึ้นอย่างสําคัญ

- PCIe พร้อมในอนาคต 40:การเชื่อมต่อความกว้างแบนด์ไวด์เป็นสองเท่ากับโฮสต์ โดยกําจัดข้อจํากัดในการเชื่อมต่อเครือข่าย 200Gb/s

- การจัดการที่ง่าย:สตั๊กไดรเวอร์ที่รวมกัน (OFED, WinOF-2) และความเข้ากันของระบบปฏิบัติการที่กว้างขวาง ลดความซับซ้อนในการจัดจําหน่าย

กลุ่มฮ่องกงสตาร์สเซอร์จ (Hong Kong Starsurge Group) ให้การสนับสนุนทางเทคนิคผู้เชี่ยวชาญ, การครอบคลุมการรับประกัน, และบริการ RMA ทั่วโลกสําหรับ NVIDIA ConnectXการปรับประสิทธิภาพและการบูรณาการผ้า เราให้ราคาที่ยืดหยุ่น ราคากลางสําหรับโครงการศูนย์ข้อมูล และการจัดส่งทั่วโลกอย่างรวดเร็วติดต่อทีมงานขายของเรา เพื่อหารือเกี่ยวกับเวลานําและส่วนลดปริมาณ.

• ตรวจสอบช่อง PCIe ให้พลังงานเพียงพอ (75W จากช่อง; ตัวปรับใช้ใช้ ~ 22-24W แบบปกติ)

• สําหรับแพลตฟอร์มที่ทําความเย็นด้วยของเหลว บัตรทําความเย็นด้วยอากาศแบบมาตรฐานนี้ไม่เข้ากันได้กับรุ่นแผ่นเย็น; ติดต่อ Starsurge สําหรับความต้องการของ SKU ที่ทําความเย็นด้วยของเหลว

• ใช้เคเบิลหรือโมดูลที่ได้รับการจัดอันดับ QSFP56 ให้ได้ 200Gb/s

• ยืนยันความสอดคล้องของรุ่นไดรเวอร์กับระบบปฏิบัติการและเนอร์เนลของคุณก่อนการจัดจําหน่าย

ตั้งแต่ปี 2008 บริษัท ฮ่องกง สตาร์สอร์จ กรุ๊ป จํากัด เป็นผู้ให้บริการที่เชื่อถือได้ของอุปกรณ์เครือข่ายธุรกิจ, การบูรณาการระบบ, และบริการไอทีในฐานะพันธมิตรที่ได้รับอนุญาตสําหรับ NVIDIA Networking Solutions, Starsurge ส่งแอดป์เตอร์ ConnectX ของแท้, สวิตช์และเคเบิลให้กับรัฐบาล, การเงิน, การดูแลสุขภาพ, การศึกษา, และลูกค้าขนาดสูงทั่วโลกทีมงานขายและเทคนิคที่ประสบการณ์ของเรา รับประกันการใช้งานที่เรียบร้อย จากสถาปัตยกรรมก่อนการขาย ไปยังการสนับสนุนหลังการขาย, ด้วยความมุ่งมั่นในคุณภาพที่น่าเชื่อถือและการบริการที่ตอบสนอง

การจัดส่งทั่วโลก · การสนับสนุนหลายภาษา · บริการ OEM และการบูรณาการที่ปรับปรุงตามความต้องการ

| ส่วนประกอบ / ระบบนิเวศ | สถานะการสนับสนุน | ความเห็น |

|---|---|---|

| NVIDIA Quantum HDR InfiniBand Switches | ✓ ได้รับการสนับสนุนอย่างเต็มที่ | เนื้อผ้า 200Gb/s, การตั้งทางปรับปรุง |

| เครื่องสวิทช์ 200GbE (IEEE 802.3) | ✓ สอดคล้อง | ต้องการโหมด FEC ต่อรายละเอียดสวิตช์ |

| GPU Direct RDMA | ✓ ใช่ | NVIDIA GPU ซีรี่ย์ (Volta, Ampere, Hopper ฯลฯ) |

| VMware vSphere 7.0/80 | ✓ ได้รับการรับรอง | ผู้ขับรถพื้นเมือง, การสนับสนุน SR-IOV |

| ลินูคัส (RHEL, Ubuntu, SLES) | ✓ การสนับสนุนอย่างเต็มที่ | MLNX_OFED, ไดรเวอร์กล่องเข้า |

| วินโดว์เซอร์เวอร์ 2019/2022 | ✓ ได้รับการสนับสนุน | แพคเกจ Driver WinOF-2 |

- [ ] ยืนยันความเร็วการเชื่อมที่ต้องการ: 200Gb / s ท่าเรือเดียวตรงกับความต้องการความกว้างแบนด์เวทของ node ของคุณ

- [ ] ตรวจสอบสล็อต PCIe ของเซอร์เวอร์: สล็อตฟิสิกส์ x16 Gen 4 แนะนําสําหรับการทํางานเต็ม 200Gb / s

- [ ] เลือกสายไฟ QSFP56 ที่เหมาะสมหรือเครื่องรับสัญญาณ (ทองแดงที่ไม่ทํางานสูงถึง 5m, AOC หรือออทติก)

- [ ] ตรวจสอบการสนับสนุน Driver ของระบบปฏิบัติการ (OFED version หรือ Inbox)

- [ ] รับประกันความเป็นไปตามความต้องการในการเข้ารหัส (XTS-AES, FIPS)

- [ ] การประเมินการปรับปรุงความเย็นของสภาพแวดล้อม: เครื่องปรับความเร็วสูงอาจต้องการการระบายอากาศโดยตรง