NVIDIA ConnectX-6 InfiniBand Adapter MCX653105A-HDAT – 200Gb/s RDMA การเข้ารหัสฮาร์ดแวร์

รายละเอียดสินค้า:

| ชื่อแบรนด์: | Mellanox |

| หมายเลขรุ่น: | MCX653106A-HDAT-SP |

| เอกสาร: | connectx-6-infiniband.pdf |

การชำระเงิน:

| จำนวนสั่งซื้อขั้นต่ำ: | 1 ชิ้น |

|---|---|

| ราคา: | Negotiate |

| รายละเอียดการบรรจุ: | กล่องด้านนอก |

| เวลาการส่งมอบ: | ขึ้นอยู่กับสินค้าคงคลัง |

| เงื่อนไขการชำระเงิน: | ที/ที |

| สามารถในการผลิต: | จัดหาโดย Project/Batch |

|

ข้อมูลรายละเอียด |

|||

| สถานะผลิตภัณฑ์: | คลังสินค้า | แอปพลิเคชัน: | เซิร์ฟเวอร์ |

|---|---|---|---|

| เงื่อนไข: | ใหม่และเป็นต้นฉบับ | พิมพ์: | แบบมีสาย |

| ความเร็วสูงสุด: | สูงถึง 200 gb/s | ตัวเชื่อมต่ออีเธอร์เน็ต: | QSFP56 |

| แบบอย่าง: | MCX653106A-HDAT | ชื่อ: | MCX653106A-HDAT-SP การ์ดเครือข่าย Mellanox 200gbe สมาร์ทเซฟความเร็วสูง |

รายละเอียดสินค้า

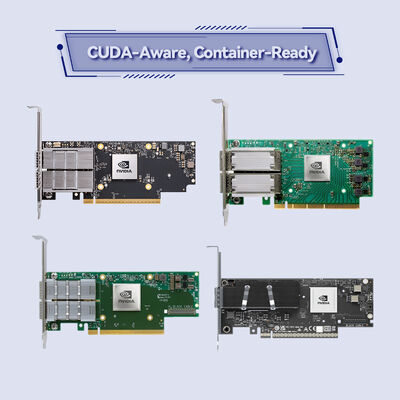

MCX653105A-HDAT – พอร์ตเดี่ยว 200Gb/s

ออกแบบมาสำหรับโครงสร้างพื้นฐาน HPC, AI และคลาวด์ขนาดใหญ่ที่ต้องการประสิทธิภาพสูง การ์ดอะแดปเตอร์อัจฉริยะ NVIDIA® ConnectX®-6 MCX653105A-HDAT ให้แบนด์วิดท์ 200Gb/s บนพอร์ต QSFP56 พอร์ตเดียวพร้อมการเร่งความเร็ว In-Network Computing การประมวลผลงานการเคลื่อนย้ายข้อมูลที่สำคัญและการรักษาความปลอดภัยออกจาก CPU ช่วยเพิ่มประสิทธิภาพ ความสามารถในการปรับขนาด และความปลอดภัยได้อย่างมาก — ตั้งแต่การฝึกโครงข่ายประสาทเทียมเชิงลึกไปจนถึงการวิเคราะห์ข้อมูลแบบเรียลไทม์และ NVMe-oF storage.

ในฐานะส่วนประกอบหลักของแพลตฟอร์ม NVIDIA Quantum InfiniBand ConnectX-6 ช่วยให้สามารถใช้งาน RDMA แบบ end-to-end, การขนส่งที่เชื่อถือได้ด้วยฮาร์ดแวร์ และการควบคุมการแออัดขั้นสูง รุ่นพอร์ตเดี่ยว MCX653105A-HDAT นำเสนอทางเลือกที่คุ้มค่าแต่ทรงพลังสำหรับการเข้าสู่เครือข่าย 200Gb/s HDR InfiniBand และ 200GbE มีการรวมการเข้ารหัส XTS-AES ระดับบล็อก, การประมวลผล NVMe over Fabrics (NVMe-oF) และการเร่งความเร็ว GPUDirect RDMA — ทำให้เป็นตัวเลือกที่เหมาะสมที่สุดสำหรับคลัสเตอร์ที่เร่งความเร็วด้วย GPU, ซอฟต์แวร์กำหนดพื้นที่จัดเก็บข้อมูล และสภาพแวดล้อมการซื้อขายความถี่สูงที่ความหน่วงแฝงต่ำและความปลอดภัยมีความสำคัญสูงสุด.

NVIDIA ConnectX-6 ขยาย Remote Direct Memory Access (RDMA) เกินขีดจำกัดทั่วไป ด้วยการใช้การประมวลผลฮาร์ดแวร์สำหรับการจับคู่แท็ก MPI, RDMA แบบไม่เรียงลำดับที่รองรับ Adaptive Routing และ Dynamically Connected Transport (DCT) ทำให้มั่นใจได้ถึงการปรับขนาดที่มีประสิทธิภาพทั่วทั้งโหนดหลายพันโหนด ความสามารถ In-Network Memory ของอะแดปเตอร์ช่วยให้สามารถเข้าถึงหน่วยความจำ RDMA โดยไม่ต้องลงทะเบียน ลดภาระซอฟต์แวร์ เมื่อรวมกับ PCIe Gen 4.0 ข้อมูลจะเคลื่อนย้ายโดยตรงระหว่างหน่วยความจำและเครือข่าย ทำให้ CPU ว่างสำหรับตรรกะแอปพลิเคชัน นอกจากนี้ การขนส่งที่เชื่อถือได้ด้วยฮาร์ดแวร์และการควบคุมการไหลของแพ็กเก็ตแบบ end-to-end รับประกันความสมบูรณ์ของข้อมูลแม้ภายใต้ภาระงานที่หนักหน่วง

ด้วยการรองรับ RoCE (RDMA over Converged Ethernet), การประมวลผลอุโมงค์เครือข่ายซ้อนทับ และการรวมขัดจังหวะอัจฉริยะ ConnectX-6 จึงมอบผ้าอัจฉริยะแบบรวมสำหรับทั้งสภาพแวดล้อม InfiniBand และ Ethernet.

- High Performance Computing (HPC): การจำลองขนาดใหญ่, การสร้างแบบจำลองสภาพอากาศ, เคมีเชิงคำนวณที่ต้องการความหน่วงแฝงต่ำที่แน่นอน.

- AI & Machine Learning: เร่งการฝึกแบบกระจายของโครงข่ายประสาทเทียมเชิงลึกด้วย GPUDirect RDMA และปริมาณงาน 200Gb/s.

- NVMe-oF Storage Arrays: สร้างเป้าหมาย NVMe/TCP หรือ NVMe/RDMA ประสิทธิภาพสูงด้วยการประมวลผลฮาร์ดแวร์ ลดภาระ CPU ได้ถึง 30%.

- Hyperscale Cloud & NFV: การเชื่อมต่อบริการที่มีประสิทธิภาพ, การประมวลผล OVS (ASAP²), และ SR-IOV สำหรับฟังก์ชันเสมือนสูงสุด 1K.

- Financial Services & Trading: การกระจายข้อมูลตลาดความหน่วงแฝงต่ำพิเศษและโครงสร้างพื้นฐานการซื้อขายอัลกอริทึม.

ConnectX-6 MCX653105A-HDAT เข้ากันได้กับเซิร์ฟเวอร์, สวิตช์ และสภาพแวดล้อม OS ที่หลากหลาย รองรับ สวิตช์ InfiniBand สูงสุด 200Gb/s (HDR) และ สวิตช์ Ethernet สูงสุด 200Gb/s พร้อมการเจรจาต่อรองอัตโนมัติและโหมด FEC ทั้งหมด อะแดปเตอร์ทำงานได้บนแพลตฟอร์มที่ใช้ x86, Power, Arm, GPU และ FPGA.

| หมวดหมู่ | ตัวเลือก / มาตรฐานที่รองรับ |

|---|---|

| ระบบปฏิบัติการ | RHEL, SLES, Ubuntu, การแจกจ่าย Linux หลักอื่นๆ, Windows Server, FreeBSD, VMware vSphere |

| ข้อกำหนด InfiniBand | สอดคล้องกับ IBTA 1.3, 200/100/50/25/10Gb/s, 8 เลนเสมือน + VL15, การควบคุมการแออัดด้วยฮาร์ดแวร์ |

| มาตรฐาน Ethernet | 200/100/50/40/25/10/1GbE, IEEE 802.3bj, 802.3by, 802.3ba, PFC, ETS, DCB, 1588v2, Jumbo frame (9.6KB) |

| การประมวลผล CPU & Virtualization | SR-IOV (สูงสุด 1K VFs), NPAR, DPDK, การประมวลผล OVS ASAP², การเข้ารหัส/ถอดรหัสอุโมงค์ (VXLAN, NVGRE, Geneve) |

| การจัดการ & การบูต | NC-SI, MCTP ผ่าน SMBus/PCIe, PLDM (DSP0248/DSP0267), UEFI, PXE, การบูตระยะไกล iSCSI, การบูตระยะไกล InfiniBand |

| พารามิเตอร์ | รายละเอียด |

|---|---|

| รุ่นผลิตภัณฑ์ | MCX653105A-HDAT |

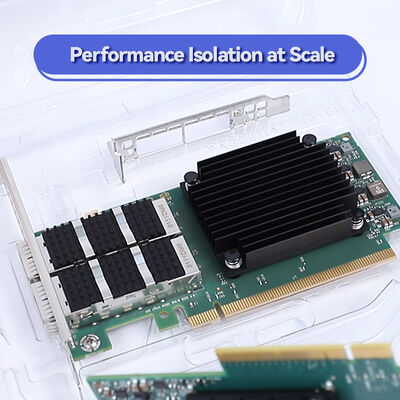

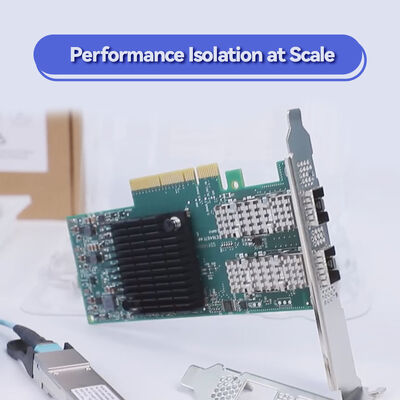

| ฟอร์มแฟกเตอร์ | PCIe Stand-up, มีขายึดโปรไฟล์ต่ำให้, ติดตั้งขายึดสูง, ขายึดสั้นเป็นอุปกรณ์เสริม |

| พอร์ตเครือข่าย | 1x QSFP56 (พอร์ตเดี่ยว) |

| ความเร็วที่รองรับ (InfiniBand) | 200/100/50/25/10 Gb/s |

| ความเร็วที่รองรับ (Ethernet) | 200/100/50/40/25/10/1 Gb/s |

| อินเทอร์เฟซโฮสต์ | PCIe Gen 3.0/4.0 x16 (รองรับ x8, x4, x2, x1 ด้วย) |

| แบนด์วิดท์สูงสุด | 200Gb/s |

| อัตราข้อความ | สูงสุด 215 ล้านข้อความต่อวินาที |

| ความหน่วงแฝง | ต่ำมาก (RDMA น้อยกว่าไมโครวินาที) |

| การเข้ารหัสฮาร์ดแวร์ | การเข้ารหัสระดับบล็อก XTS-AES 256/512 บิต, รองรับ FIPS |

| การประมวลผลพื้นที่จัดเก็บข้อมูล | NVMe-oF target/initiator, T10-DIF, SRP, iSER, NFS RDMA, SMB Direct |

| Virtualization | SR-IOV (สูงสุด 1K VFs), VMware NetQueue, QoS ต่อ VM |

| การบูตระยะไกล | InfiniBand, Ethernet, iSCSI, UEFI, PXE |

| ขนาด (ไม่รวมขายึด) | 167.65 มม. x 68.90 มม. |

| RoHS & การปฏิบัติตามข้อกำหนด | สอดคล้องกับ RoHS, เข้ากันได้กับ ODCC |

| หมายเลขชิ้นส่วนสั่งซื้อ (OPN) | พอร์ต / ความเร็ว | อินเทอร์เฟซโฮสต์ | คุณสมบัติหลัก |

|---|---|---|---|

| MCX653105A-HDAT | 1x QSFP56, สูงสุด 200Gb/s | PCIe 3.0/4.0 x16 | พอร์ตเดี่ยว, รองรับการเข้ารหัส, ขายึดมาตรฐาน |

| MCX653106A-HDAT | 2x QSFP56, สูงสุด 200Gb/s | PCIe 3.0/4.0 x16 | พอร์ตคู่, รองรับการเข้ารหัส |

| MCX653105A-ECAT | 1x QSFP56, สูงสุด 100Gb/s | PCIe 3.0/4.0 x16 | รุ่น 100Gb/s, ไม่มีการเข้ารหัส |

| MCX653435A-HDAT (OCP 3.0) | 1x QSFP56, 200Gb/s | PCIe x16 | ฟอร์มแฟกเตอร์ขนาดเล็ก OCP 3.0 |

| MCX654105A-HCAT | 1x QSFP56, Socket Direct | 2x PCIe 3.0 x16 | Socket Direct พร้อมการเข้าถึง CPU โดยเฉพาะ |

หมายเหตุ: สำหรับรุ่นที่ระบายความร้อนด้วยของเหลวสำหรับ Intel Server System D50TNP โปรดติดต่อ Starsurge เพื่อสั่งซื้อแบบกำหนดเอง

อะแดปเตอร์ NVIDIA ConnectX-6 ของแท้ 100% พร้อมการตรวจสอบย้อนกลับของชุดผลิตภัณฑ์เต็มรูปแบบ.

ศูนย์คลังสินค้าในเอเชีย ยุโรป และอเมริกา ให้บริการกว่า 50 ประเทศ.

การกำหนดค่าเฟิร์มแวร์, การปรับแต่ง RDMA, การตรวจสอบ NVMe-oF, ความช่วยเหลือไดรเวอร์.

ความร่วมมือระยะยาวกับผู้จัดจำหน่าย NVIDIA, มีส่วนลดตามปริมาณ.

การเปลี่ยนสินค้าโดยไม่ยุ่งยากและการจัดส่งล่วงหน้าสำหรับการใช้งานที่สำคัญ.

รองรับภาษาอังกฤษ จีน ญี่ปุ่น; บริการรวมระบบและติดฉลากแบบกำหนดเอง.

Hong Kong Starsurge Group ให้การสนับสนุนแบบ end-to-end: ตั้งแต่การตรวจสอบความเข้ากันได้, การปรับแต่งเฟิร์มแวร์, ไปจนถึงคำแนะนำในการติดตั้ง ณ สถานที่ เรามีผู้จัดการบัญชีทางเทคนิคเฉพาะสำหรับการอัปเกรดศูนย์ข้อมูลและการทดสอบพิสูจน์แนวคิด (PoC) อะแดปเตอร์ทั้งหมดจัดส่งพร้อมบรรจุภัณฑ์ป้องกันไฟฟ้าสถิตและชุดติดตั้งเสริม.

ข้อเสนอการสนับสนุนรวมถึง: ระบบตั๋วสนับสนุนทางวิศวกรรม 24/5, การเปลี่ยนสินค้าล่วงหน้าสำหรับสภาพแวดล้อมที่สำคัญทางธุรกิจ, ความช่วยเหลือเกี่ยวกับสแต็กไดรเวอร์และซอฟต์แวร์ (OFED, WinOF-2, DPDK), และการแก้ไขปัญหาจากระยะไกล.

- ยืนยันพื้นที่ว่างทางกลของเซิร์ฟเวอร์: มีขายึด PCIe ความสูงมาตรฐานให้; มีขายึดโปรไฟล์ต่ำเป็นอุปกรณ์เสริม.

- สำหรับแพลตฟอร์มที่ระบายความร้อนด้วยของเหลว (Intel D50TNP) โปรดยืนยันความพร้อมใช้งานของตัวเลือกแผ่นระบายความร้อนก่อนสั่งซื้อ — ขายึดระบายความร้อนด้วยอากาศมาตรฐานเป็นค่าเริ่มต้น.

- โปรดยืนยันความเข้ากันได้ของไดรเวอร์กับเวอร์ชัน Linux distribution ของคุณ — แนะนำ NVIDIA MLNX_OFED เพื่อประสิทธิภาพสูงสุด.

- ไม่ได้ระบุต่อสาธารณะ: การใช้พลังงานที่แน่นอนภายใต้โหลด 200Gb/s เต็ม — โปรดดูคู่มือผู้ใช้ NVIDIA หรือติดต่อ Starsurge สำหรับค่าทั่วไป (ประมาณ 13-16W).

- การรับรอง FIPS สามารถทำได้ด้วยฮาร์ดแวร์ แต่อาจต้องใช้เวอร์ชันเฟิร์มแวร์เฉพาะ — แจ้งทีมขายหากการปฏิบัติตาม FIPS เป็นข้อบังคับสำหรับการใช้งานของคุณ.

- อะแดปเตอร์พอร์ตเดี่ยวไม่สามารถใช้สำหรับความซ้ำซ้อนของพอร์ต; สำหรับการออกแบบที่มีความพร้อมใช้งานสูง ให้พิจารณา MCX653106A-HDAT แบบพอร์ตคู่.

ก่อตั้งขึ้นในปี 2008 Hong Kong Starsurge Group Co., Limited เป็นผู้ให้บริการด้านฮาร์ดแวร์เครือข่าย บริการด้านไอที และโซลูชันการรวมระบบที่ขับเคลื่อนด้วยเทคโนโลยี ด้วยฐานลูกค้าทั่วโลกที่ครอบคลุมภาครัฐ สุขภาพ การผลิต การศึกษา การเงิน และภาคธุรกิจ Starsurge นำเสนออุปกรณ์เครือข่ายประสิทธิภาพสูง รวมถึงสวิตช์ NIC โซลูชันไร้สาย และซอฟต์แวร์ที่ปรับแต่งได้ บริษัทได้รวมทีมขายและทีมเทคนิคที่มีประสบการณ์เพื่อสนับสนุนโครงการโครงสร้างพื้นฐานที่ซับซ้อน การใช้งาน IoT และระบบการจัดการเครือข่าย แนวทางที่ยึดลูกค้าเป็นศูนย์กลาง คุณภาพที่เชื่อถือได้ และการจัดส่งทั่วโลกที่ตอบสนอง ทำให้ Starsurge เป็นพันธมิตรที่เชื่อถือได้สำหรับศูนย์ข้อมูลยุคหน้า.

ติดต่อทีม Starsurge →| ข้อเท็จจริง | ค่า |

|---|---|

| ปริมาณงานสูงสุด | 200Gb/s (พอร์ตเดี่ยว) |

| เอนจิ้นเร่งความเร็วบนชิป | การจับคู่แท็ก, การประมวลผล rendezvous, การประมวลผลการดำเนินการร่วม, การประมวลผล burst buffer |

| ฟังก์ชันเสมือนสูงสุด | สูงสุด 1024 VFs ต่ออะแดปเตอร์ |

| มาตรฐานการเข้ารหัส | XTS-AES 256/512 บิต, ประมวลผลด้วยฮาร์ดแวร์จาก CPU |

| การรองรับ Adaptive Routing | RDMA แบบไม่เรียงลำดับพร้อม Adaptive Routing |

| In-Network Memory | การเข้าถึงหน่วยความจำ RDMA โดยไม่ต้องลงทะเบียน |

| เซิร์ฟเวอร์ / แพลตฟอร์ม | สถาปัตยกรรม CPU | OS / สภาพแวดล้อมที่ทดสอบแล้ว |

|---|---|---|

| Dell PowerEdge R750/R760 | Intel Xeon Scalable Gen 3/4 | RHEL 8.6+, Ubuntu 22.04, VMware ESXi 7.0/8.0 |

| HPE ProLiant DL380 Gen10/Gen11 | Intel Xeon | SLES 15 SP4, Windows Server 2022 |

| Supermicro Ultra SuperServer | AMD EPYC 7002/7003 | Ubuntu 20.04/22.04, Rocky Linux 8 |

| Lenovo ThinkSystem SR650/SR655 | Intel / AMD EPYC | RHEL 9, Windows Server 2019 |

| NVIDIA DGX A100 / H100 | x86_64 / NVIDIA Arm | Ubuntu พร้อม MLNX_OFED, NVIDIA HPC SDK |

- ☑ ความพร้อมใช้งานของสล็อต PCIe: x16 ทางกล (รองรับ x16/x8/x4 ทางไฟฟ้า)

- ☑ ความเร็วพอร์ตที่ต้องการ: 200Gb/s หรือต่ำกว่า; ประเภทสายเคเบิล (QSFP56 passive DAC หรือ active optics)

- ☑ เวอร์ชันไดรเวอร์ OS: ตรวจสอบความเข้ากันได้ของ MLNX_OFED หรือ WinOF-2 กับเคอร์เนลของคุณ

- ☑ ข้อกำหนดการเข้ารหัส: AES-XTS มาตรฐาน หรือโหมด FIPS (เฟิร์มแวร์พิเศษ)

- ☑ การระบายความร้อนและขายึด: ระบายความร้อนด้วยอากาศมาตรฐาน หรือตัวเลือกแผ่นระบายความร้อนสำหรับระบายความร้อนด้วยของเหลว

- ☑ ปริมาณและระยะเวลารอคอย: ยืนยันสต็อกกับทีมขาย Starsurge

- ☑ แอปพลิเคชันที่ตั้งใจไว้: พอร์ตเดี่ยวเพียงพอ หรือต้องการความซ้ำซ้อนของพอร์ตคู่?

ซีรีส์ QM8700 / QM9700, 40 พอร์ต HDR 200Gb/s, จัดการเต็มรูปแบบ

ปรับให้เหมาะสมสำหรับ Ethernet และ RoCE, 200Gb/s พร้อมการใช้พลังงานต่ำ

InfiniBand/Ethernet พร้อมเส้นทางข้อมูลที่ตั้งโปรแกรมได้และการแยก

สายเคเบิล DAC, AOC และ active fiber สำหรับ 200G QSFP56

- ▸ คู่มือผู้ใช้ NVIDIA ConnectX-6 (คู่มือเฟิร์มแวร์และการกำหนดค่า)

- ▸ แนวทางปฏิบัติที่ดีที่สุดในการใช้งาน RDMA over Converged Ethernet (RoCE)

- ▸ NVMe-oF กับ ConnectX-6: คู่มือการปรับแต่งประสิทธิภาพ

- ▸ GPUDirect RDMA สำหรับคลัสเตอร์ AI – ภาพรวมทางเทคนิค

- ▸ การตั้งค่าการเข้ารหัสระดับบล็อกสำหรับสภาพแวดล้อม FIPS