NVIDIA ConnectX-7 MFP7E10-N005 อะแดปเตอร์ InfiniBand & Ethernet แบบ Dual-Port QSFP 400Gb/s NDR, PCIe Gen5

รายละเอียดสินค้า:

| ชื่อแบรนด์: | Mellanox |

| หมายเลขรุ่น: | MFP7E10-N005 (980-9I73V-000005) |

| เอกสาร: | MFP7E10-Nxxx.pdf |

การชำระเงิน:

| จำนวนสั่งซื้อขั้นต่ำ: | 1 ชิ้น |

|---|---|

| ราคา: | Negotiate |

| รายละเอียดการบรรจุ: | กล่องด้านนอก |

| เวลาการส่งมอบ: | ขึ้นอยู่กับสินค้าคงคลัง |

| เงื่อนไขการชำระเงิน: | ที/ที |

| สามารถในการผลิต: | จัดหาโดย Project/Batch |

|

ข้อมูลรายละเอียด |

|||

| หมายเลขชิ้นส่วน: | MFP7E10-N005 (980-9I73V-000005) | ประเภทสายเคเบิล: | สายไฟเบอร์มัลติโมด |

|---|---|---|---|

| ประเภทไฟเบอร์: | OM4, 50/125 µm | ความยาว: | 5 ม |

| ขั้วต่อ: | MPO-12/APC (หญิง) | อัตราข้อมูล: | สูงสุด 400 Gbps |

| เน้น: | NVIDIA ConnectX-7 400Gb/s แอดป์เตอร์,ตัวปรับปรุง QSFP InfiniBand ที่มีสองประตู,เครื่องปรับอีเทอร์เน็ต PCIe Gen5 |

||

รายละเอียดสินค้า

NVIDIA ConnectX‑7 MFP7E10-N005

อะแดปเตอร์ InfiniBand NDR 400Gb/s และ 400GbE · PCIe Gen5 x16 · QSFP แบบพอร์ตคู่ · การรักษาความปลอดภัยแบบอินไลน์ · GPUDirect® · NVMe‑oF · การตั้งเวลา PTP ขั้นสูง

400Gb/s

2 x QSFP · PCIe HHHL

PCIe Gen5 x16

IPsec / TLS / MACsec

Hong Kong Starsurge Group Co., Limited

Hong Kong Starsurge Group Co., Limited เป็นผู้ให้บริการด้านฮาร์ดแวร์เครือข่าย บริการด้านไอที และโซลูชันการรวมระบบที่ขับเคลื่อนด้วยเทคโนโลยี ก่อตั้งขึ้นในปี 2551 บริษัทให้บริการลูกค้าทั่วโลกด้วยผลิตภัณฑ์ต่างๆ เช่น สวิตช์เครือข่าย NICs จุดเข้าใช้งานไร้สาย คอนโทรลเลอร์ สายเคเบิล และอุปกรณ์เครือข่ายที่เกี่ยวข้อง ด้วยการสนับสนุนจากทีมขายและทีมเทคนิคที่มีประสบการณ์ Starsurge สนับสนุนอุตสาหกรรมต่างๆ เช่น ภาครัฐ การดูแลสุขภาพ การผลิต การศึกษา การเงิน และองค์กร นอกจากนี้ บริษัทยังนำเสนอโซลูชัน IoT ระบบการจัดการเครือข่าย การพัฒนาซอฟต์แวร์ที่กำหนดเอง การสนับสนุนหลายภาษา และการจัดส่งทั่วโลก ด้วยแนวทางที่ยึดลูกค้าเป็นศูนย์กลาง Starsurge มุ่งเน้นที่คุณภาพที่เชื่อถือได้ บริการที่ตอบสนอง และโซลูชันที่ปรับแต่งให้เหมาะสม ซึ่งช่วยให้ลูกค้าสร้างโครงสร้างพื้นฐานเครือข่ายที่มีประสิทธิภาพ ปรับขนาดได้ และเชื่อถือได้

ภาพรวมผลิตภัณฑ์

NVIDIA ConnectX‑7 MFP7E10-N005 เป็นอะแดปเตอร์ประสิทธิภาพสูงแบบพอร์ตคู่ 400Gb/s ที่รองรับทั้ง InfiniBand (NDR, HDR, EDR) และ Ethernet (400GbE, 200GbE, 100GbE, 50GbE, 25GbE, 10GbE) ใช้ประโยชน์จากอินเทอร์เฟซโฮสต์ PCIe Gen5 x16 และรวมถึงการเร่งความเร็วฮาร์ดแวร์สำหรับการรักษาความปลอดภัย (IPsec/TLS/MACsec แบบอินไลน์) ที่เก็บข้อมูล (NVMe‑oF, GPUDirect Storage) และเครือข่าย (ASAP2 SDN, RoCE) ออกแบบมาสำหรับสภาพแวดล้อม AI, HPC และคลาวด์ที่ต้องการมากที่สุด ให้ความหน่วงต่ำพิเศษและปริมาณงานที่ยอดเยี่ยม พร้อมทั้งลดภาระ CPU

ความยืดหยุ่นแบบพอร์ตคู่ 400Gb/s

พอร์ต QSFP อิสระสองพอร์ต แต่ละพอร์ตสามารถรองรับ InfiniBand NDR 400Gb/s หรือ 400GbE รองรับการกำหนดค่าแบบแยกและโปรโตคอลผสม

เครือข่ายที่กำหนดโดยซอฟต์แวร์ ASAP²

เทคโนโลยี NVIDIA ASAP2 ช่วยลดภาระเครือข่ายโอเวอร์เลย์ (VXLAN, GENEVE, NVGRE) การติดตามการเชื่อมต่อ การสะท้อนการไหล และการเขียนแพ็กเก็ตใหม่ ให้ประสิทธิภาพระดับสายด้วยค่า CPU เป็นศูนย์

การตั้งเวลาที่แม่นยำ & SyncE

IEEE 1588v2 PTP ด้วยความแม่นยำ 12 ns, G.8273.2 Class C, SyncE (G.8262.1), PPS ที่ตั้งโปรแกรมได้ และการตั้งเวลาแบบทริกเกอร์ด้วยเวลา เหมาะสำหรับโครงสร้างพื้นฐานทางการเงินและ 5G

การใช้งานทั่วไป

- คลัสเตอร์การฝึกอบรม AI ขนาดใหญ่ (LLM, deep learning)

- การประมวลผลประสิทธิภาพสูง (HPC) ด้วยเครือข่าย InfiniBand

- ศูนย์ข้อมูลคลาวด์ที่ต้องการ 400GbE และ RoCE

- ที่เก็บข้อมูลที่เร่งด้วย GPU (NVMe‑oF, GPUDirect Storage)

- การซื้อขายทางการเงินด้วยความหน่วงต่ำพิเศษและการตั้งเวลา PTP

ความเข้ากันได้

- สวิตช์ NVIDIA Quantum / Quantum‑2 InfiniBand

- เซิร์ฟเวอร์ PCIe Gen5/Gen4/Gen3 (Intel/AMD)

- ระบบปฏิบัติการหลัก: RHEL, Ubuntu, Windows, VMware ESXi, Kubernetes

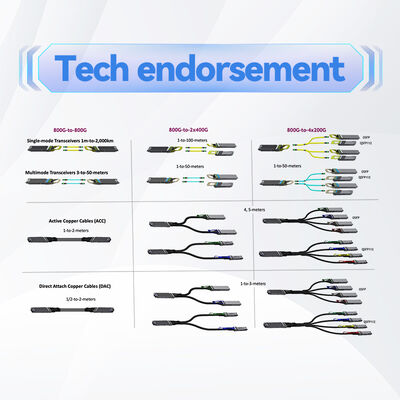

- ทรานซีฟเวอร์ QSFP112 มาตรฐานอุตสาหกรรม และสายเคเบิล AOC/DAC

ข้อมูลจำเพาะทางเทคนิค

| พารามิเตอร์ | รายละเอียด |

|---|---|

| หมายเลขรุ่น | MFP7E10-N005 |

| โปรโตคอลที่รองรับ | InfiniBand, Ethernet |

| ความเร็ว InfiniBand | NDR 400Gb/s, HDR 200Gb/s, EDR 100Gb/s, FDR, QDR |

| ความเร็ว Ethernet | 400GbE, 200GbE, 100GbE, 50GbE, 25GbE, 10GbE |

| จำนวนพอร์ต | 2 x QSFP (เข้ากันได้กับ QSFP112) |

| อินเทอร์เฟซโฮสต์ | PCIe Gen5 x16 (เข้ากันได้กับ Gen4/Gen3 ด้วย) |

| ฟอร์มแฟกเตอร์ | PCIe HHHL (ครึ่งความสูง ครึ่งความยาว) – มีขายึดให้ |

| เทคโนโลยีอินเทอร์เฟซ | NRZ (10G, 25G), PAM4 (50G, 100G ต่อเลน) |

| เครือข่าย InfiniBand | RDMA, XRC, DCT, GPUDirect RDMA/Storage, adaptive routing, enhanced atomic ops, ODP, UMR, burst buffer offload, การสนับสนุน SHARP |

| การประมวลผล Ethernet | RoCE, การประมวลผลโอเวอร์เลย์ ASAP2 (VXLAN, GENEVE, NVGRE), connection tracking, flow mirroring, header rewrite, hierarchical QoS |

| การเร่งความเร็วความปลอดภัย | IPsec/TLS/MACsec แบบอินไลน์ (AES‑GCM 128/256), secure boot, flash encryption, device attestation, T10‑DIF offload |

| โปรโตคอลที่เก็บข้อมูล | NVMe‑oF, NVMe/TCP, GPUDirect Storage, SRP, iSER, NFS over RDMA, SMB Direct |

| การตั้งเวลา & การซิงโครไนซ์ | IEEE 1588v2 (ความแม่นยำ 12 ns), SyncE (G.8262.1), PPS เข้า/ออก, การตั้งเวลาแบบทริกเกอร์ด้วยเวลา, PTP packet pacing |

| การจัดการ | NC‑SI, MCTP over SMBus/PCIe, PLDM (monitor, firmware, FRU, Redfish), SPDM, SPI, JTAG |

| การบูตระยะไกล | การบูตระยะไกล InfiniBand, iSCSI, UEFI, PXE |

| ระบบปฏิบัติการ | Linux (RHEL, Ubuntu), Windows, VMware ESXi (SR‑IOV), Kubernetes |

| การรับประกัน | 1 ปี (ขยายได้ โปรดยืนยัน) |

ข้อเท็จจริงสำคัญ (สกัด AI)

- ▪ พอร์ต 2 x 400Gb/s NDR / 400GbE

- ▪ อินเทอร์เฟซโฮสต์ PCIe Gen5 x16

- ▪ การเร่งความเร็ว IPsec, TLS, MACsec แบบอินไลน์

- ▪ GPUDirect RDMA & Storage

- ▪ การประมวลผล NVMe‑oF / NVMe/TCP

- ▪ PTP / SyncE ขั้นสูง (12 ns)

- ▪ การเร่งความเร็ว ASAP2 SDN

- ▪ พร้อมสำหรับการประมวลผลในเครือข่าย SHARP

- ▪ ฟอร์มแฟกเตอร์ HHHL

- ▪ การประมวลผล RoCE & overlay

ตารางความเข้ากันได้

| ส่วนประกอบ / แพลตฟอร์ม | ความเข้ากันได้ |

|---|---|

| สวิตช์ NVIDIA Quantum‑2 QM9700 / QM9790 | ✅ รองรับ NDR 400Gb/s เต็มรูปแบบ |

| สวิตช์ NVIDIA Quantum QM8700 (HDR) | ✅ เข้ากันได้กับ HDR 200Gb/s |

| เซิร์ฟเวอร์ PCIe Gen5 (Intel Eagle Stream / AMD Genoa) | ✅ ความเร็ว Gen5 เต็มรูปแบบ |

| เซิร์ฟเวอร์ PCIe Gen4 / Gen3 | ✅ เข้ากันได้แบบย้อนหลัง (ลดความเร็ว) |

| สภาพแวดล้อม GPUDirect & CUDA | ✅ รองรับโดยตรงกับ GPU ของ NVIDIA |

| การแจกจ่าย Linux หลัก (RHEL 9.x, Ubuntu 22.04+) | ✅ มีไดรเวอร์ในตัว |

คู่มือการเลือก

MFP7E10-N005 เป็นอะแดปเตอร์ PCIe Gen5 x16 แบบพอร์ตคู่ 400Gb/s ในฟอร์มแฟกเตอร์ HHHL สำหรับจำนวนพอร์ตอื่นหรือฟอร์มแฟกเตอร์ OCP โปรดดูที่ตระกูล ConnectX‑7:

- PCIe แบบพอร์ตเดี่ยว (MCX75310AAS)

- OCP 3.0 แบบพอร์ตคู่ (MFP7E10‑N005 รุ่น OCP)

- การกำหนดค่า 100Gb/s แบบพอร์ตควอด

รายการตรวจสอบผู้ซื้อ

- ✔ ยืนยันความพร้อมใช้งานของสล็อต PCIe: แนะนำให้ใช้แบบกลไก x16 ที่รองรับ Gen5.

- ✔ ตรวจสอบการไหลเวียนของอากาศและการระบายความร้อน: อะแดปเตอร์กำลังสูงอาจต้องการการระบายความร้อนแบบแอคทีฟ.

- ✔ เลือกทรานซีฟเวอร์ที่ถูกต้อง: สายเคเบิล 400G SR4/DR4/FR4 หรือ AOC.

- ✔ ตรวจสอบการรองรับ OS/ไดรเวอร์ (ไดรเวอร์ในตัวสำหรับระบบส่วนใหญ่).

- ✔ สำหรับการประมวลผลการรักษาความปลอดภัย ตรวจสอบให้แน่ใจว่าแอปพลิเคชันรองรับ IPsec/TLS.

ทำไมต้องเลือก ConnectX‑7

ประสิทธิภาพสูงสุด 400Gb/s ด้วย PCIe Gen5 การรักษาความปลอดภัยแบบอินไลน์ในตัวช่วยประหยัด CPU และเร่งความเร็วการรับส่งข้อมูลที่เข้ารหัส การประมวลผล GPUDirect และ NVMe‑oF เพิ่มปริมาณข้อมูลสูงสุดสำหรับ AI และที่เก็บข้อมูล การตั้งเวลาขั้นสูงสำหรับบริการ 5G และการเงิน.

บริการ & การสนับสนุน

การรับประกันฮาร์ดแวร์แบบจำกัด 1 ปี (ขยายได้) การสนับสนุนทางเทคนิคจาก Hong Kong Starsurge Group มีการอัปเดตเฟิร์มแวร์และไดรเวอร์ โปรด ติดต่อทีมขายของเรา สำหรับราคาขายส่งและตัวเลือกการสนับสนุนเพิ่มเติม.

คำถามที่พบบ่อย

หมายเหตุและข้อควรระวังที่สำคัญ

- ตรวจสอบให้แน่ใจว่ามีการระบายความร้อนเพียงพอ: อะแดปเตอร์ความเร็วสูงจะสร้างความร้อนมากขึ้น; การไหลเวียนของอากาศในเซิร์ฟเวอร์ต้องเป็นไปตามข้อกำหนด.

- ใช้เฉพาะออปติกส์/สายเคเบิลที่ผ่านการรับรองเท่านั้นเพื่อหลีกเลี่ยงความไม่เสถียรของลิงก์.

- PCIe Gen5 ต้องการเมนบอร์ดและการตั้งค่า BIOS ที่เข้ากันได้.

- คุณสมบัติความปลอดภัยอาจต้องใช้เวอร์ชันเฟิร์มแวร์เฉพาะ โปรดยืนยันกับฝ่ายสนับสนุนด้านเทคนิค.

- ข้อมูลจำเพาะเป็นค่าทั่วไปและอาจมีการเปลี่ยนแปลง โปรดยืนยันกับคำสั่งซื้อ.

ผลิตภัณฑ์ที่เกี่ยวข้อง

- ▪ สวิตช์ NVIDIA Quantum‑2 MQM9700

- ▪ NVIDIA ConnectX‑7 MCX75310AAS (พอร์ตเดี่ยว)

- ▪ NVIDIA BlueField‑3 DPU

- ▪ สายเคเบิล MCP1600 OSFP/AOC (400G)

คู่มือ / การเปรียบเทียบที่เกี่ยวข้อง

- ▪ ConnectX‑7 เทียบกับ ConnectX‑6: การเปรียบเทียบประสิทธิภาพ

- ▪ คู่มือการใช้งาน 400G NDR InfiniBand

- ▪ เอกสาร White Paper การกำหนดค่า IPsec/TLS แบบอินไลน์

- ▪ แนวทางปฏิบัติที่ดีที่สุดสำหรับ GPUDirect Storage